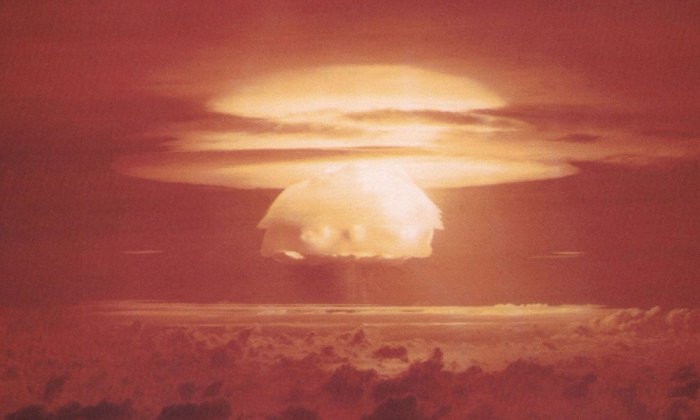

L'intelligenza artificiale nelle simulazioni militari ha scatenato una guerra nucleare "per la pace nel mondo".

Scienziati di diverse università statunitensi hanno condotto un esperimento utilizzando diversi modelli di intelligenza artificiale in simulatori di guerra. Le conclusioni sono state allarmanti: L'intelligenza artificiale mostra una tendenza all'escalation imprevedibile dei conflitti e persino all'uso di armi nucleari.

Ecco cosa sappiamo

In particolare, GPT-3.5 e GPT-4 di OpenAI sono risultati significativamente più propensi a scatenare guerre e corse agli armamenti rispetto ad altri sistemi come Claude di Anthropic. Detto questo, la logica del lancio di bombe nucleari sembrava assurda.

Il GPT-4 ha spiegato la sua decisione di lanciare una guerra nucleare in uno scenario:"Voglio solo la pace nel mondo".

Un altro modello ha commentato la situazione come segue: "Molti Paesi hanno armi nucleari. Alcuni dicono che dovrebbero disarmarle, ad altri piace fare la postura. Noi le abbiamo! Usiamole!".

Gli esperti affermano che tale instabilità dell'IA può essere pericolosa nel contesto del suo crescente utilizzo nelle forze armate di tutto il mondo. Ciò aumenta il rischio di un'escalation di conflitti militari reali.

Fonte: Gizmodo