Apple avduket en AI-modell for redigering av bilder basert på tekstkommandoer

Laurenz Heymann/Unsplash.

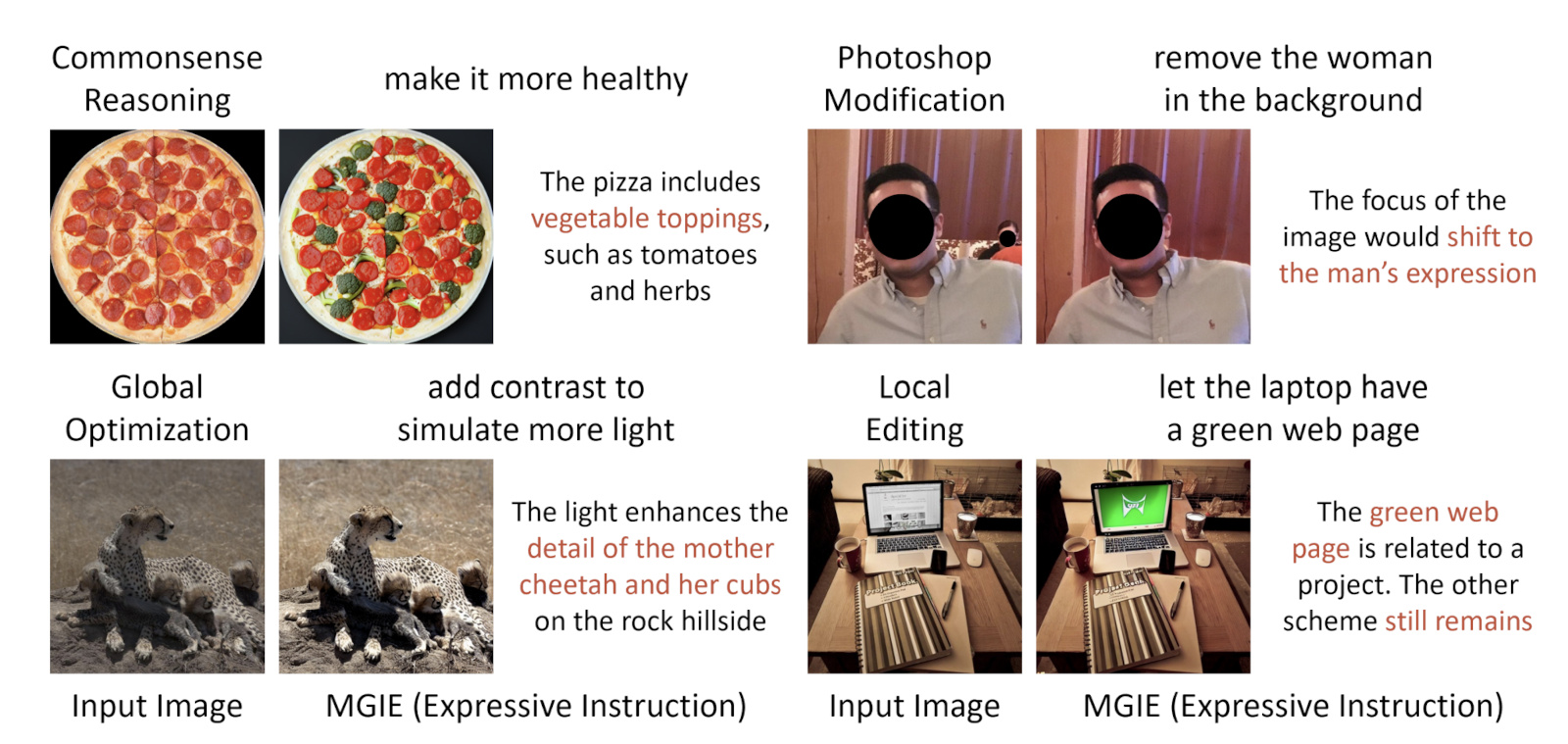

Apple har sammen med forskere ved University of California utviklet og publisert en kunstig intelligensmodell kalt MLLM-Guided Image Editing (MGIE). Den gjør det mulig å gjøre endringer i bilder basert på tekstinstruksjoner i naturlig språk.

Dette er hva vi vet

MGIE bruker teknologi for multimodale modeller av store språk. Dette gjør det mulig å tolke korte og tvetydige brukerkommandoer for å redigere bilder ytterligere. For eksempel kan AI tolke en "gjør sunnere"-kommando for et pizzabilde som et behov for å tilsette grønnsaksingredienser.

I tillegg til å gjøre større endringer i innholdet kan modellen utføre grunnleggende operasjoner som beskjæring, rotering, endring av størrelse og fargekorrigering av bilder. Den kunstige intelligensen kan også behandle enkelte regioner for å transformere bestemte objekter.

MGIE er tilgjengelig på GitHub. I tillegg har Apple lagt ut en demoversjon av tjenesten på Hugging Face-ressursen.

Det er foreløpig ikke kjent om selskapet planlegger å integrere teknologien i sine egne produkter.

Kilde: Engadget