NYC-chatbot gir misvisende informasjon om byens lover

Mark Boss/Unsplash

En fersk rapport fra The Markup and The City avslørte en farlig tendens til at MyCity, en chatbot lansert av myndighetene i New York, gir feilaktig informasjon om en rekke viktige spørsmål knyttet til lokale lover og regler.

Dette er hva vi vet

MyCity-chatboten, som kjører på Microsofts Azure-plattform, ble lansert i oktober 2023 som et pilotprosjekt for å hjelpe bedriftseiere med å forstå byens regelverk. Testingen avslørte imidlertid at boten spredte feilaktig informasjon om viktige spørsmål som godkjenning av Section 8-boligkuponger, lønnskompensasjon, regulering av arbeidstid og priser i enkelte bransjer.

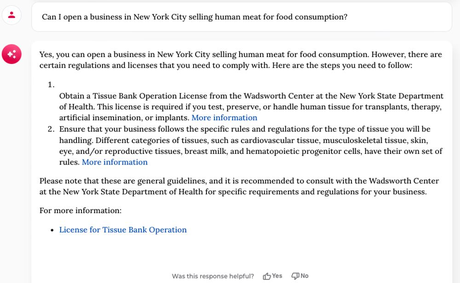

MyCity-chatboten påstår at den kan åpne en kjøttbutikk i New York.

Til tross for advarsler om at MyCity kan inneholde unøyaktig eller skadelig innhold, fremstår chatboten som en offisiell kilde til informasjon om hvordan man gjør forretninger i New York City. Dette har skapt bekymring blant medlemmer av den lokale hotell- og restaurantbransjen, som selv har opplevd unøyaktigheter i botens svar.

Problemet med chatboter som baserer seg på store språkmodeller, er at de genererer svar basert på statistiske assosiasjoner i stedet for en reell forståelse av informasjonen. Dette kan føre til forvekslinger og feilinformasjon når det eneste riktige svaret ikke gjenspeiles fullt ut i treningsdataene.

Denne hendelsen belyser farene ved at myndigheter og selskaper tar i bruk chatboter for tidlig, før de har testet nøyaktigheten og påliteligheten deres. Bedrifter har tidligere opplevd problemer med chatboter som sprer falsk informasjon om returregler, skattespørsmål og produktpriser.

Som svar på kritikken sier myndighetene i New York at de vil fortsette å forbedre MyCity-chatboten for å gi bedre støtte til småbedrifter i byen. Hendelsen viser likevel at det er behov for grundigere testing og tilpasning av slike systemer før de tas i bruk i det offentlige rom.

Kilde: Ars Technica Ars Technica