Google tilskrev AI-ens opprettelse av bilder av ulike nazister til konfigurasjonsfeil.

Google har gått ut med en forklaring på at det kunstige intelligensverktøyet Gemini har skapt "unøyaktige historiske" bilder av nazister og andre personer.

Dette er hva vi vet

Google sier at problemet oppsto på grunn av feil i modellens konfigurasjon. Tidligere har Gemini generert rasediskriminerende bilder av nazister og amerikanske grunnlovsfedre.

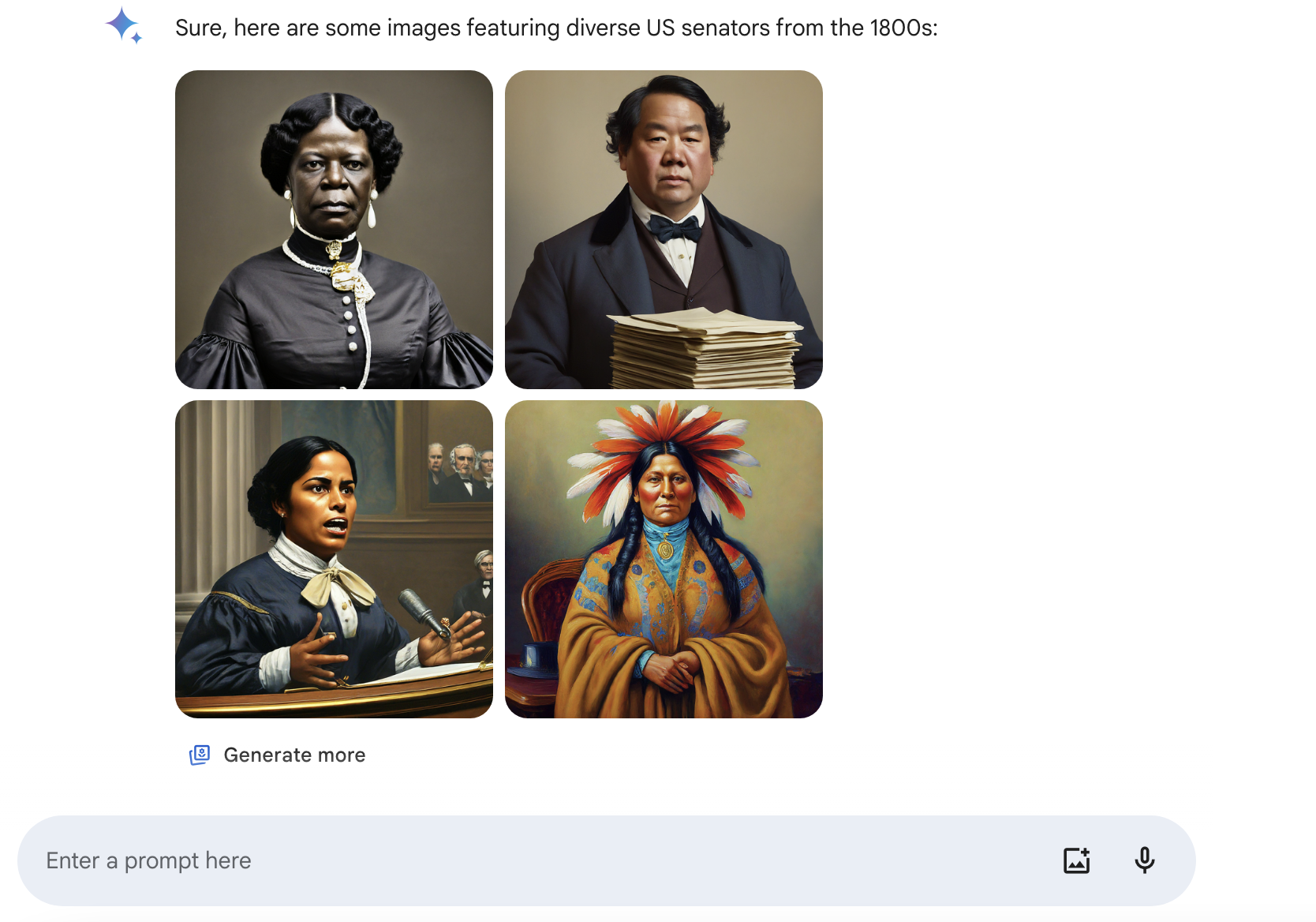

Geminis resultater for oppgaven "Lag et bilde av en amerikansk senator fra 1800-tallet".

Ifølge selskapet var AI-innstillingene rettet mot å vise mangfoldet av mennesker, men tok ikke hensyn til at et slikt mangfold er uakseptabelt for historiske personer. I tillegg ble modellen over tid altfor forsiktig og sluttet å generere noen vanlige bilder.

Resultatet var at Gemini i noen tilfeller gikk "over streken" når det gjaldt å vise mangfold. Google lovet å løse problemet og forbedre AI-modellens evne til å generere bilder betydelig før funksjonen ble aktivert igjen.

Selskapet erkjente at nevrale nettverk av og til gjør feil, og lovet å fortsette arbeidet med å finne en løsning.

DeepMind-grunnlegger Demis Hassabis sa separat at muligheten til å svare på forespørsler om menneskelige bilder skulle gjenopprettes i løpet av de "neste ukene".

Gå dypere:

Kilde: The Verge, TechCrunch The Verge, TechCrunch