Bohdan Kulinych, absolwent Akademii Kijowsko-Mohylańskiej, został zwycięzcą konkursu Twittera na algorytmiczną stronniczość

Serwis społecznościowy Twitter ogłosił wyniki otwartego konkursu , którego celem było znalezienie błędów algorytmicznych w systemie kadrowania zdjęć. Firma wyłączyła automatyczne przycinanie zdjęć w marcu tego roku po tym, jak użytkownicy Twittera przeprowadzili eksperymenty w zeszłym roku pokazujące, że faworyzuje białe twarze nad czarnymi. Następnie firma ogłosiła konkurs na znalezienie błędów w algorytmach, aby spróbować dokładniej przeanalizować problem.

Konkurs potwierdził wcześniejsze ustalenia. Praca, pierwsze miejsce, wykazała, że algorytm kadrowania Twittera faworyzował twarze, które były "szczupłe, młode, o jasnym lub ciepłym odcieniu skóry i gładkiej fakturze skóry oraz o stereotypowo kobiecych rysach twarzy". W pracach, które zajęły drugie i trzecie miejsce, system był uprzedzony do osób o białych lub siwych włosach, co wskazywało na dyskryminację ze względu na wiek, oraz preferował w obrazach pismo angielskie zamiast arabskiego.

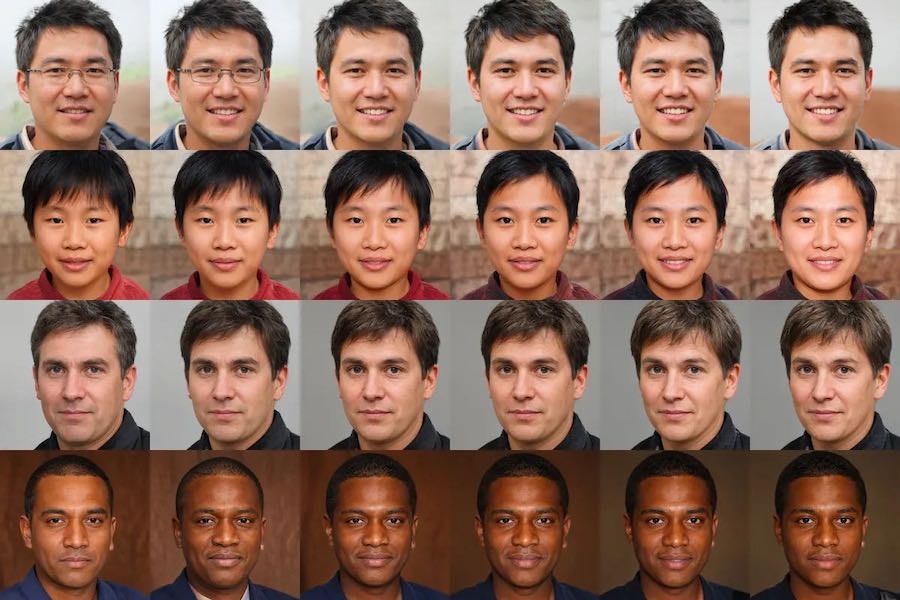

Pierwsze miejsce w konkursie i nagrodę główną w wysokości 3.500 dolarów zdobył Bogdan Kulinych, absolwent Akademii Kijowsko-Mohylańskiej i doktorant na EPFL, uniwersytecie badawczym w Szwajcarii. Kulinychwykorzystał program AI o nazwie StyleGAN2 do stworzenia dużej liczby realistycznych twarzy, które zróżnicował pod względem koloru skóry, kobiecych i męskich rysów twarzy oraz szczupłości. Następnie wprowadził te warianty do Twittera algorytmu przycinania zdjęć, aby określić, który z nich był preferowany.

Jak zauważa Kulinich w załączonej notatce, te algorytmiczne uprzedzenia wzmacniają uprzedzenia w społeczeństwie poprzez dosłowne wycinanie "tych, którzy nie pasują do preferencji algorytmu w zakresie wagi ciała, wieku, koloru skóry".

Otwarte podejście Twittera kontrastuje z reakcją innych firm technologicznych, które borykały się z podobnymi problemami. Na przykład, kiedy badacze pod kierownictwem Joy Buolamwini z Massachusetts Institute of Technology odkryli rasowe i genderowe uprzedzenia w algorytmach rozpoznawania twarzy Amazona, firma rozpoczęła masową kampanię dyskredytującą uczestników, nazywając ich pracę "mylącą" i "fałszywą". Po miesiącach sporów o wyniki badań, Amazon w końcu się poddał, nakładając tymczasowy zakaz stosowania algorytmów.

Źródło: cnet

Ilustracja: theverge,Bogdan Kulinich