Apple випустила компактні мовні моделі OpenELM для роботи на гаджетах

Mohamed M/Unsplash

Компанія Apple представила полегшені мовні моделі OpenELM, здатні працювати локально на пристроях без підключення до хмари.

Що відомо

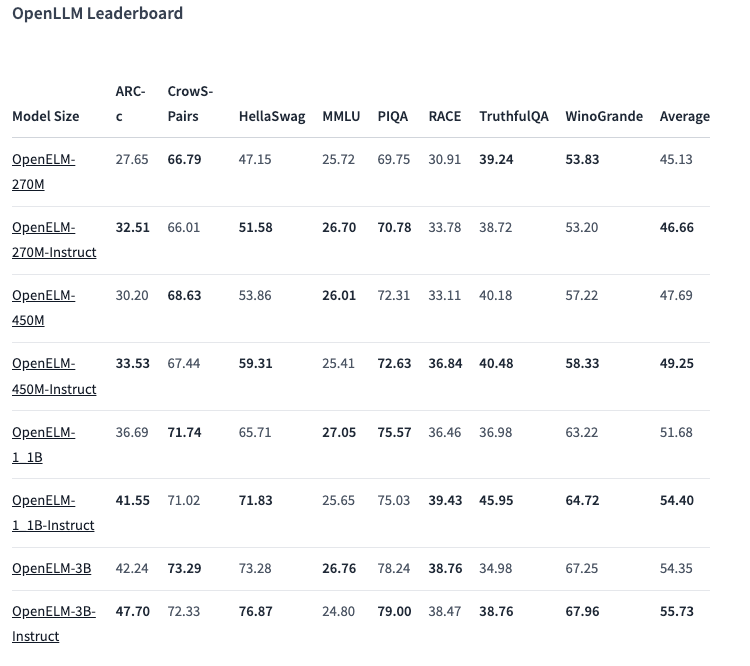

У лінійці OpenELM вісім моделей двох типів - попередньо навчені та налаштовані за інструкціями. Кожен варіант доступний із 270 млн, 450 млн, 1,1 млрд і 3 млрд параметрів.

Моделі попередньо навчалися на публічних наборах даних із 1,8 трлн токенів з таких сайтів, як Reddit, Wikipedia, arXiv.org та інших.

Завдяки оптимізації OpenELM можуть функціонувати на звичайних ноутбуках і навіть деяких смартфонах. Тести проводилися на ПК з Intel i9 і RTX 4090, а також MacBook Pro M2 Max.

За даними Apple, моделі демонструють хорошу продуктивність. Варіант на 450 млн параметрів з інструкціями особливо виділяється. А OpenELM-1.1B на 2,36% перевершила GPT-аналог OLMo, вимагаючи при цьому вдвічі менше лексем для попереднього навчання

У бенчмарку ARC-C, призначеному для перевірки знань і вмінь міркувати, попередньо навчений варіант OpenELM-3B показав точність 42,24 %. Водночас на MMLU і HellaSwag він набрав 26,76 % і 73,28 % відповідно.

Компанія опублікувала вихідний код OpenELM на Hugging Face під відкритою ліцензією, що включає навчені версії, бенчмарки та інструкції по роботі з моделями.

При цьому Apple попереджає, що OpenELM можуть видавати некоректні, шкідливі або неприйнятні відповіді через відсутність гарантій безпеки.

Джерело: VentureBeat