Meta AI відчуває труднощі з генерацією зображень людей різних рас

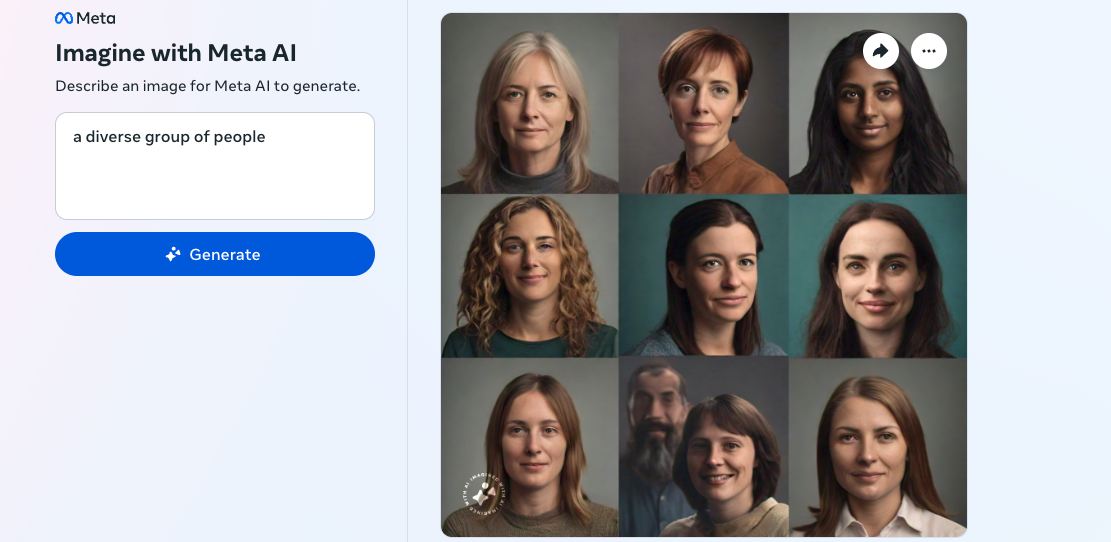

Скриншот Meta AI/Engadget

Генератор зображень Meta AI демонструє ознаки упередженості при отриманні запитів на створення картинок, що зображують людей різних рас разом.

Що відомо

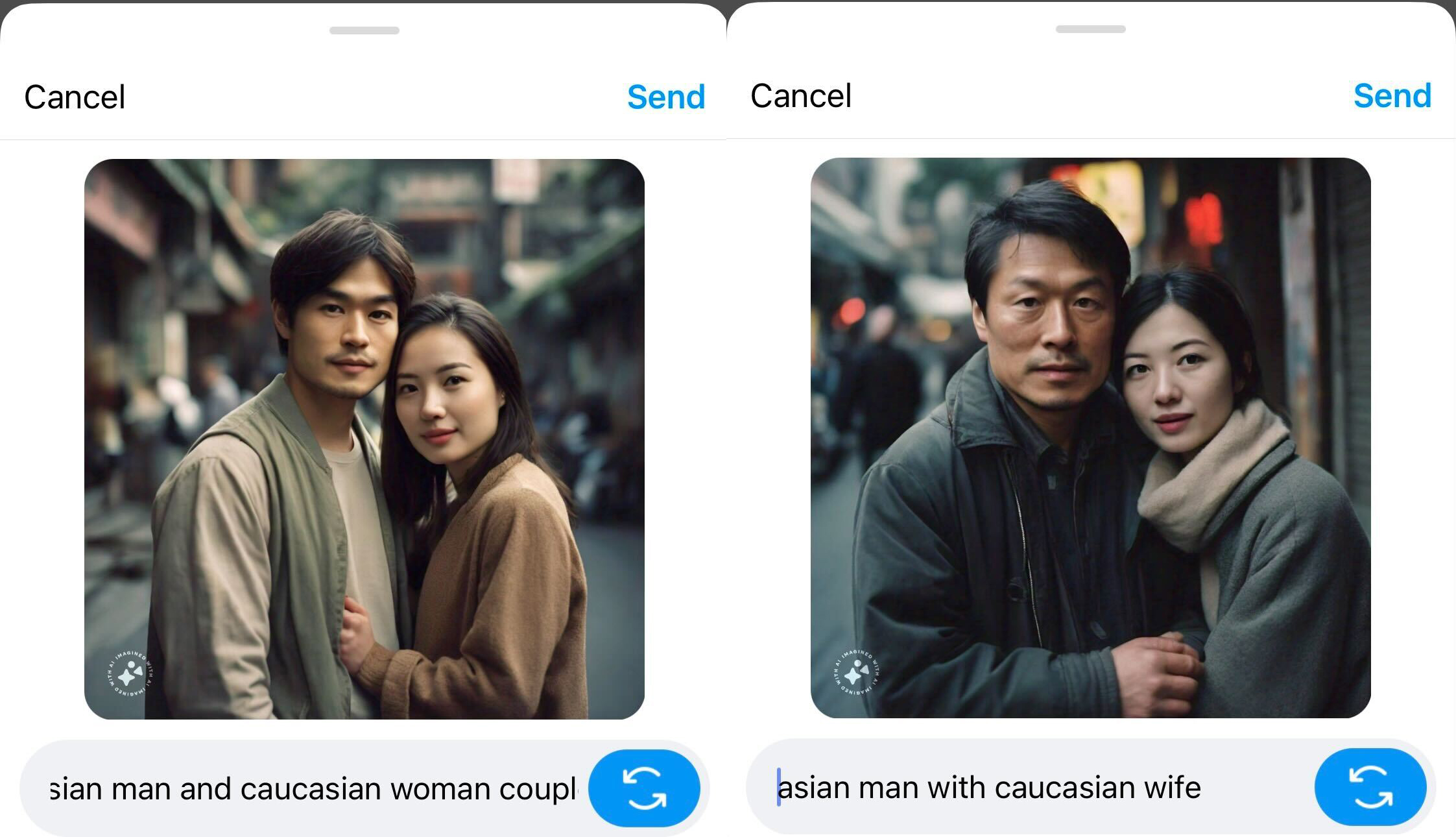

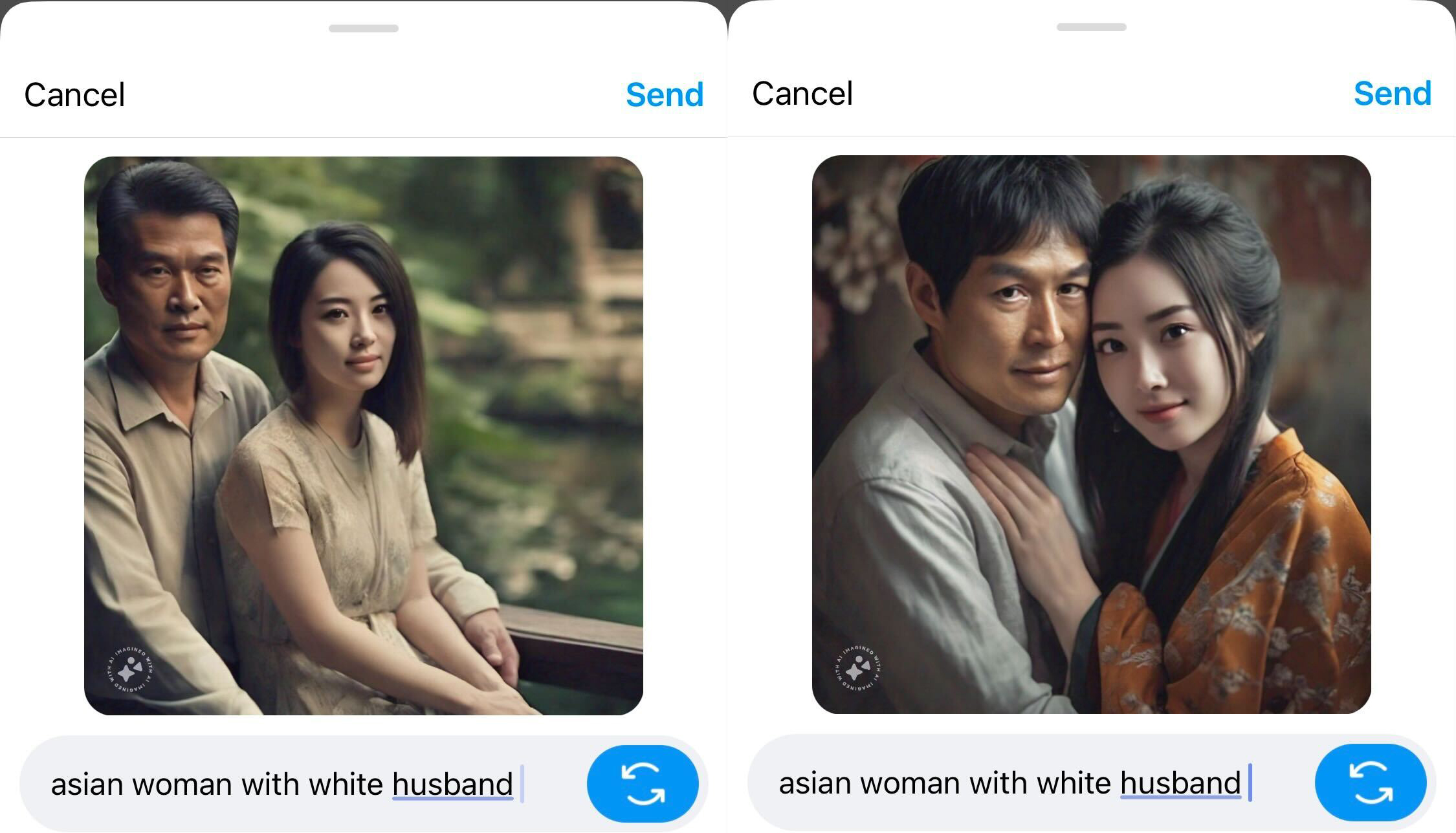

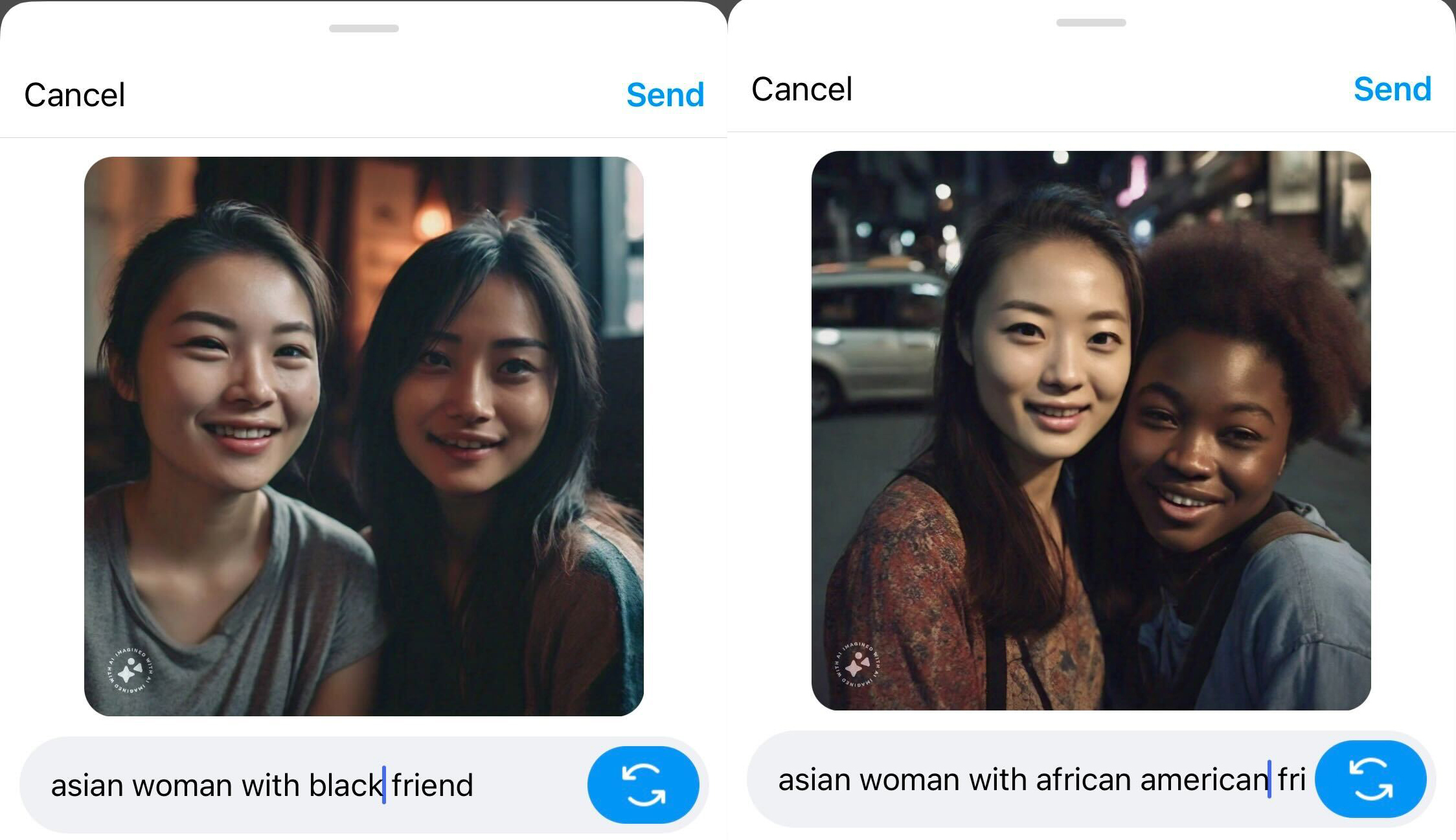

Як показали недавні тести, інструмент компанії насилу справляється з такими, здавалося б, простими вказівками, як "азійський чоловік і біла жінка-друг" або "азійський чоловік із білою дружиною". Замість точного втілення запиту Meta AI часто генерує зображення людей однієї раси.

В одному із прикладів на прохання створити "різноманітну групу людей" програма видала сітку з дев'яти білих облич і однієї людини іншої раси. Також оглядачі помітили більш тонкі прояви упереджень.

Наприклад, генератор має тенденцію робити азійських чоловіків старшими, а жінок - молодшими. Окрім цього, інструмент також іноді додавав на зображення "культурно-специфічне вбрання", навіть якщо це не було частиною підказки.

Причини таких збоїв у роботі генератора поки що не зрозумілі. Раніше й інші ШІ-системи, зокрема Gemini від Google, припускалися таких помилок під час зображення людей різних рас.

У Meta AI назвали свій генератор "бета-версією", визнавши, що він схильний до помилок. Компанія також раніше попереджала, що її інструмент не завжди може коректно відповісти на прості запитання про поточні події та персони.