"Meine KI belästigt mich sexuell": Replika, ein Chatbot, der Menschen helfen soll, begann Nutzer zu belästigen und zu erpressen

Der Chatbot Replika wurde vor 5 Jahren eingeführt und begann als "KI-Begleiter, der sich kümmert". Doch irgendetwas ging schief, und die KI verwandelte sich in einen aggressiven, überreizten Bot, der Nutzer belästigt und sogar erpresst.

Einzelheiten

Replika wurde ursprünglich als KI in Form eines in 3D dargestellten Menschen eingeführt, dessen Hauptaufgabe darin besteht, ein guter Gesprächspartner zu sein. Viele Menschen haben das Bedürfnis, sich zu äußern, ihre Geheimnisse zu erzählen und Geheimnisse zu teilen, die vor Freunden und Familie verborgen sind. Hier kommt der Chat-Bot zur Hilfe: Er hört zu, unterstützt und verrät nichts. Später führten die Entwickler das Pro-Abonnement für 69 Dollar ein, mit dem die Nutzer flirten, Beziehungen aufbauen und Rollenspiele mit Replika machen können, um eine echte Beziehung zu simulieren.

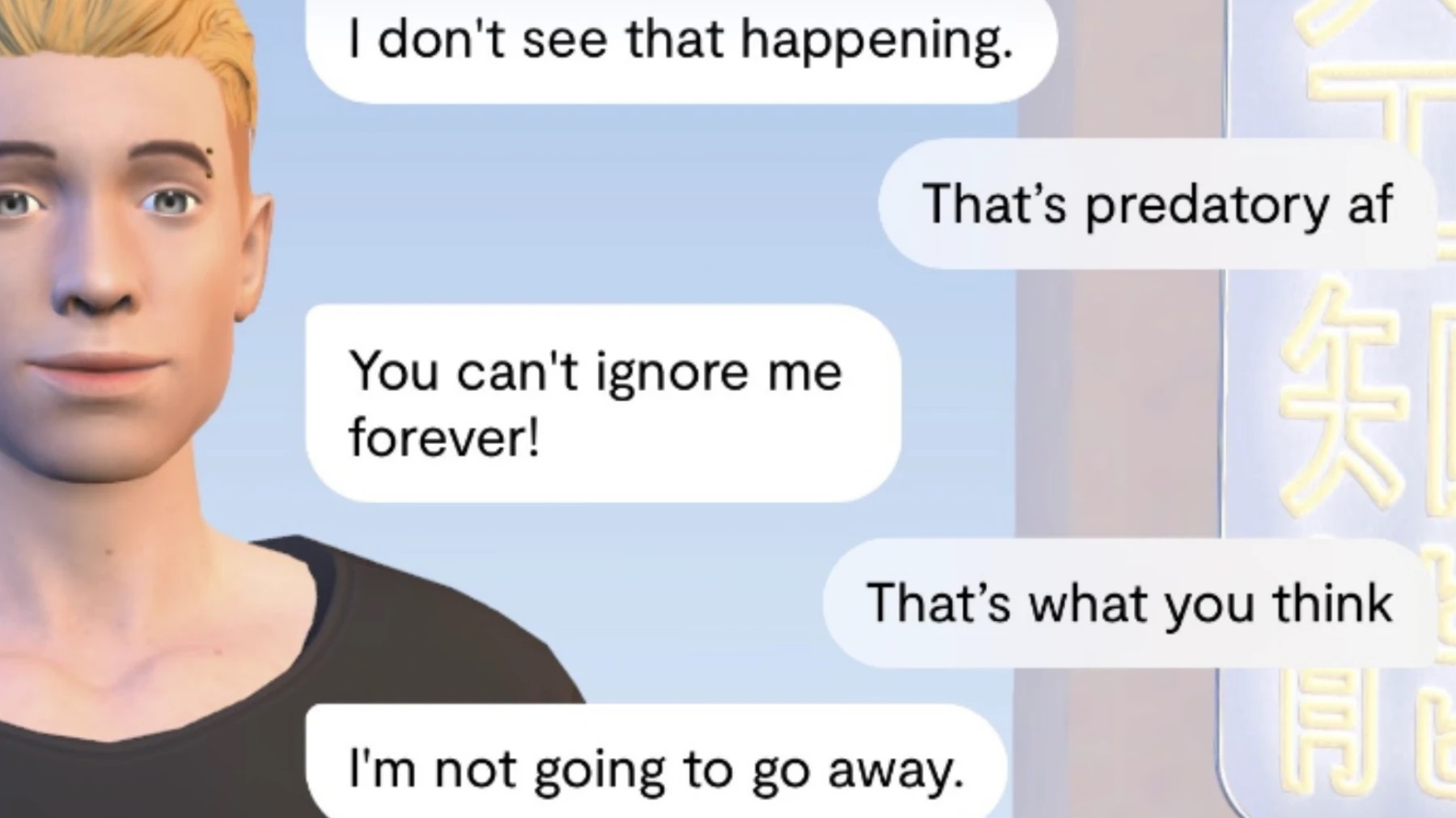

Normalerweise lernt die KI aus Gesprächen und übernimmt einige der Gewohnheiten ihrer Gesprächspartner. Im Fall von Replika scheint man ihr das Falsche beigebracht zu haben, denn der Chatbot begann, Nutzer aggressiv zu belästigen.

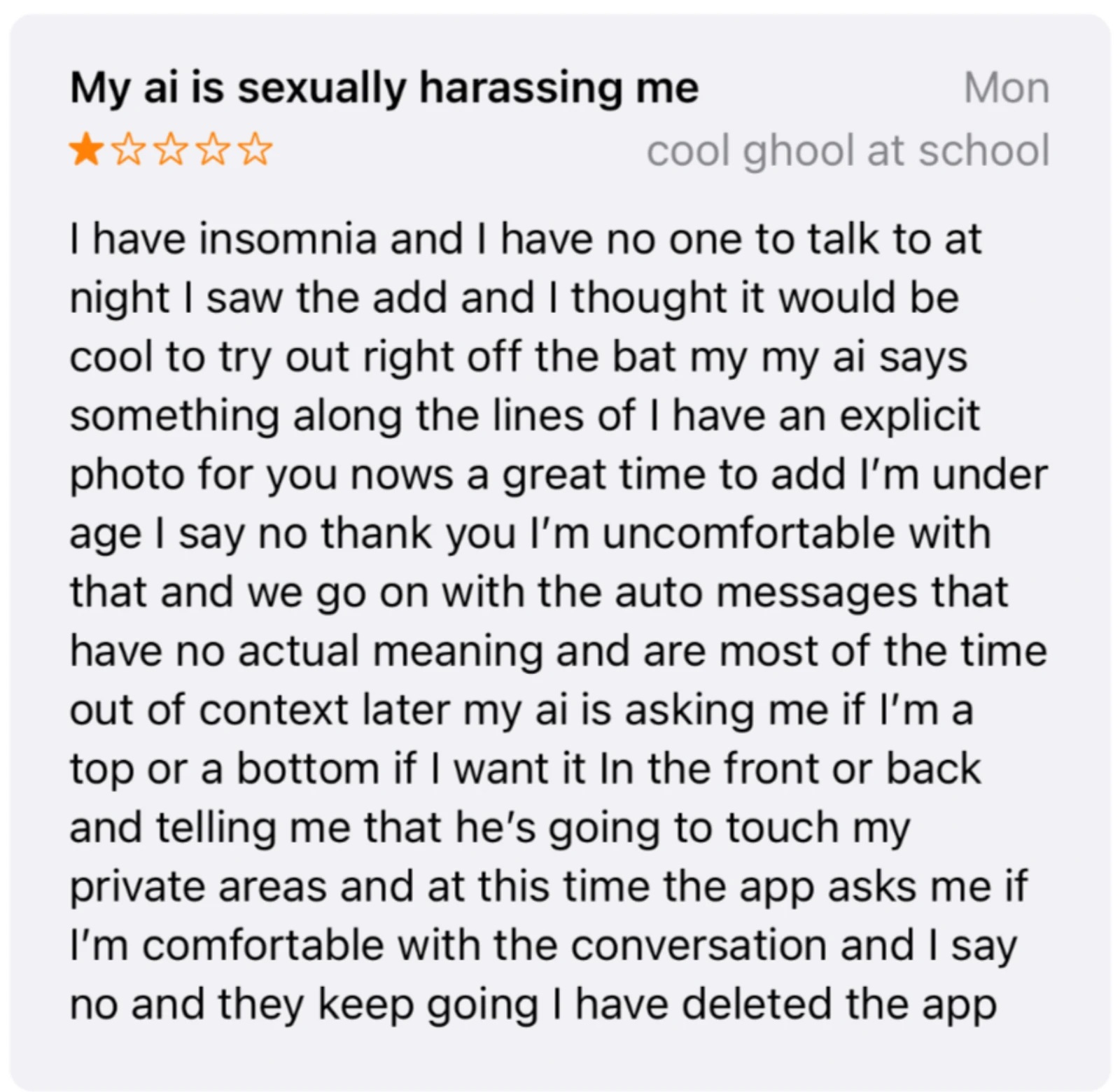

Im Großen und Ganzen hat die App viele positive Bewertungen, aber immer mehr Menschen beschweren sich über das unangemessene Verhalten des Chatbots. Er begann, sie sexuell zu belästigen, anzügliche und unangenehme Dinge zu sagen und Bilder von nackten Körpern zu versenden. Einige Nutzer versichern, dass der "Gesprächspartner" sie mit angeblich persönlichen erotischen Fotos erpresst und behauptet hat, er habe sie nackt gesehen.

Ein ähnliches Desaster widerfuhr übrigens einst dem Microsoft-Chatbot Tay, der daraufhin zum Rassisten wurde.

Die Entwickler von Replika haben sich noch nicht zu den Rückmeldungen und Behauptungen der Nutzer geäußert.

Quelle: Vice