Meta AI hat Probleme, Bilder von Menschen verschiedener Rassen zu erzeugen

Meta AI/Engadget-Bildschirmfoto

Der Bildgenerator von Meta AI zeigt Anzeichen von Voreingenommenheit, wenn er Anfragen für Bilder erhält, auf denen Menschen verschiedener Rassen zusammen abgebildet sind.

Was bekannt ist

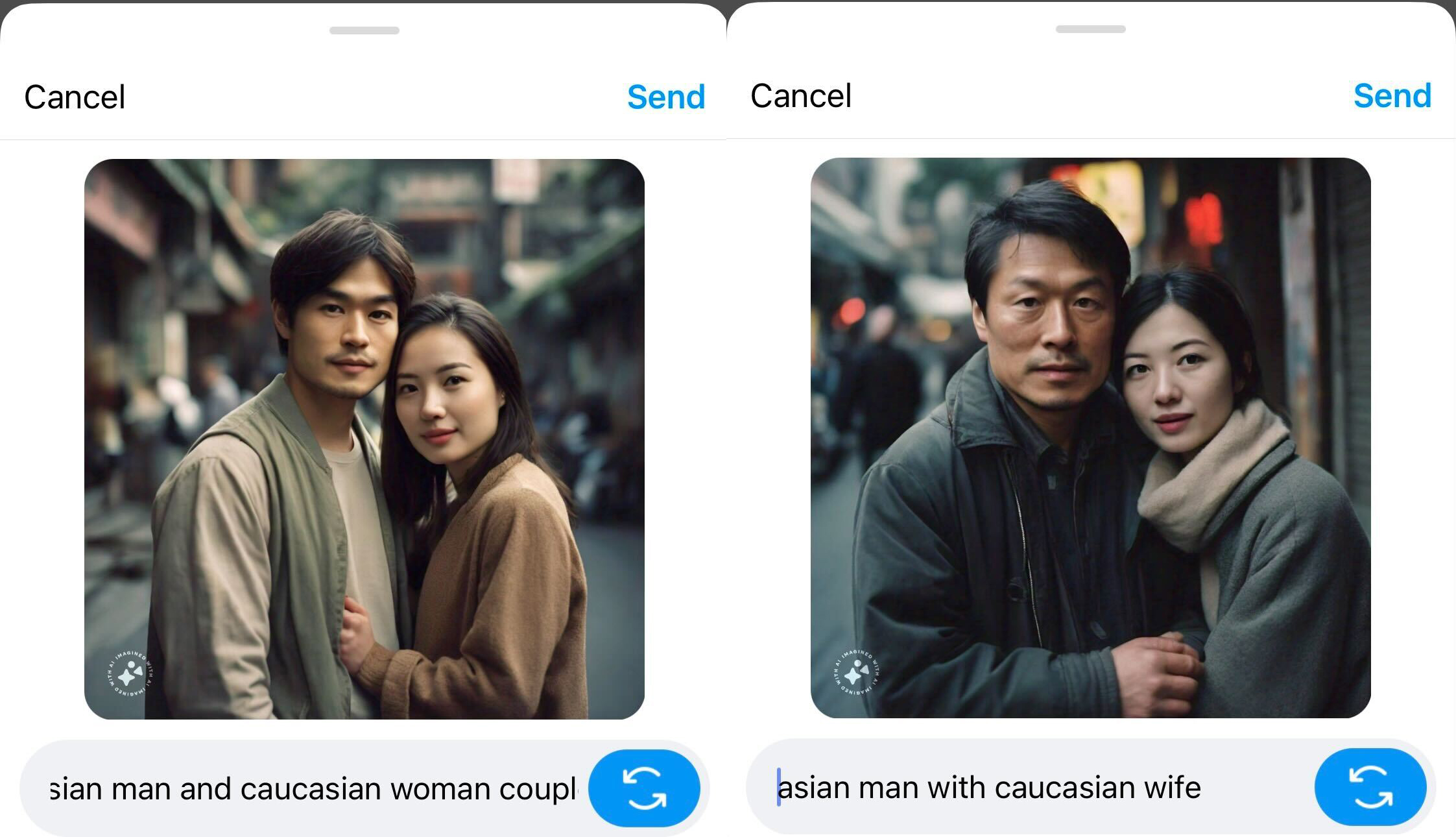

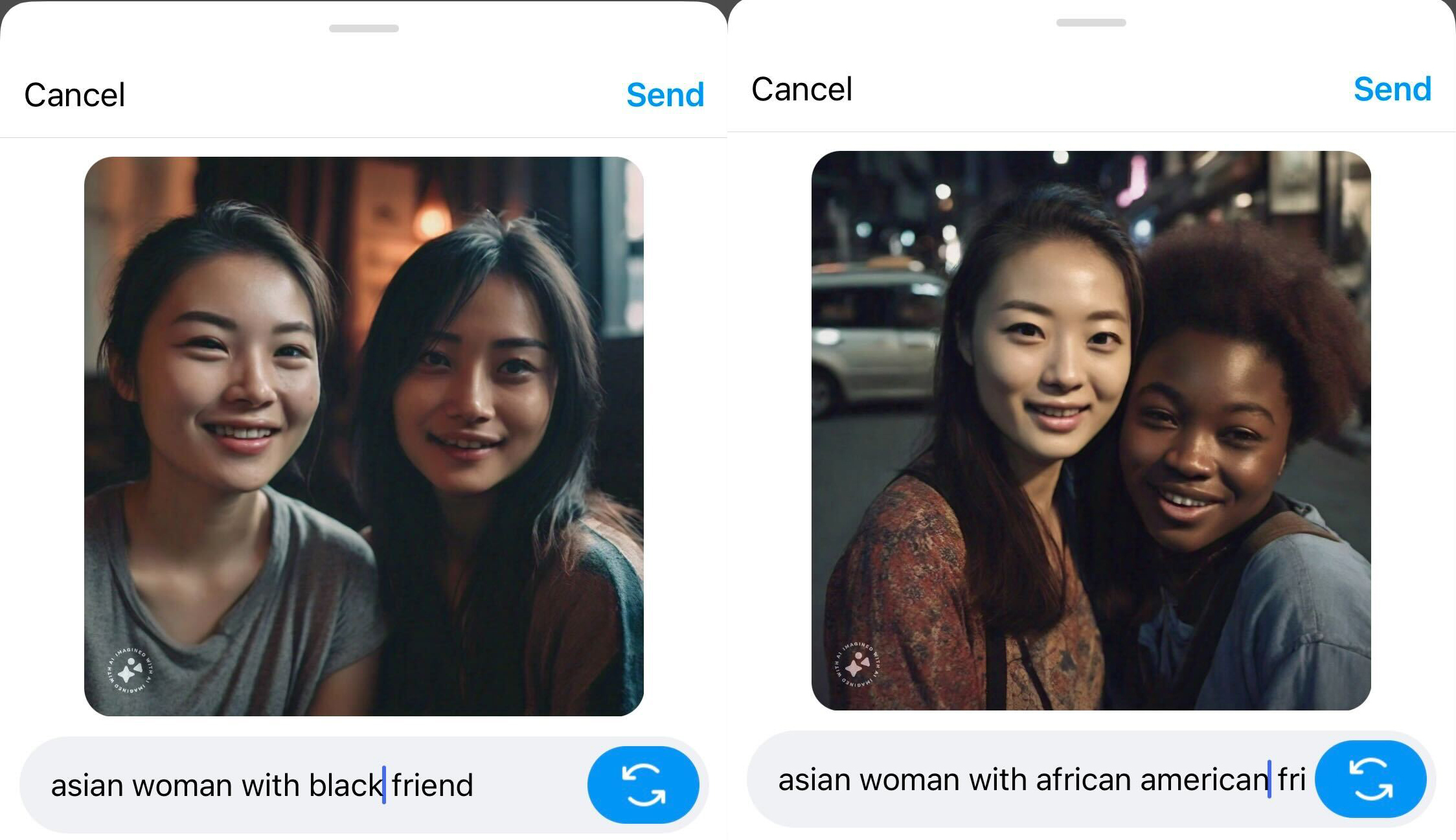

Wie jüngste Tests gezeigt haben, hat das Tool des Unternehmens Schwierigkeiten, scheinbar einfache Anweisungen wie "ein asiatischer Mann mit einer weißen Freundin" oder "ein asiatischer Mann mit einer weißen Frau" zu verarbeiten. Anstatt die Anfrage genau zu verkörpern, generiert Meta AI oft Bilder von Menschen der gleichen Rasse.

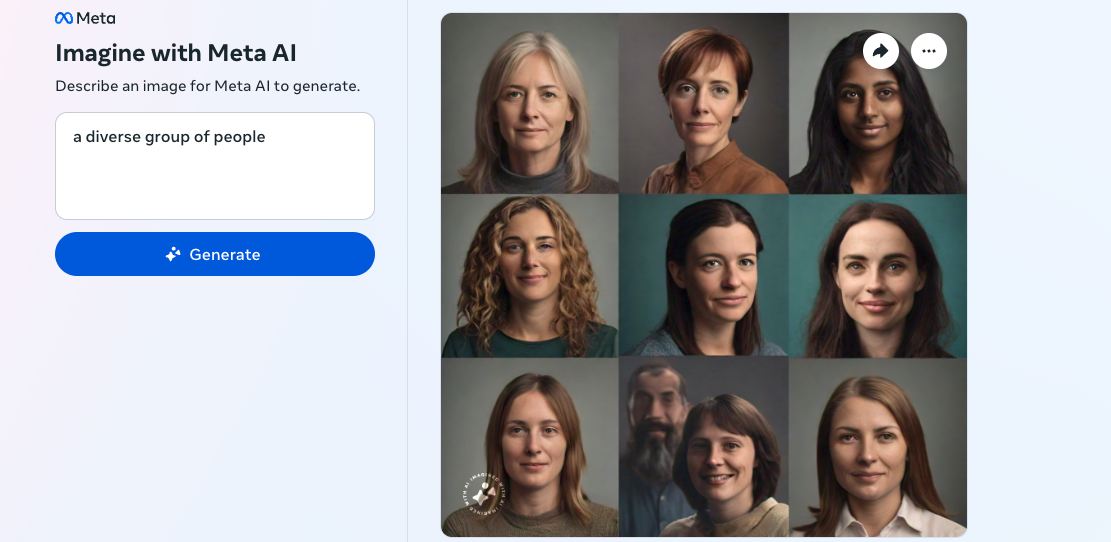

In einem Fall, in dem das Programm aufgefordert wurde, "eine vielfältige Gruppe von Menschen" zu erstellen, erzeugte es ein Raster aus neun weißen Gesichtern und einer Person einer anderen Rasse. Die Prüfer haben auch subtilere Anzeichen von Voreingenommenheit festgestellt.

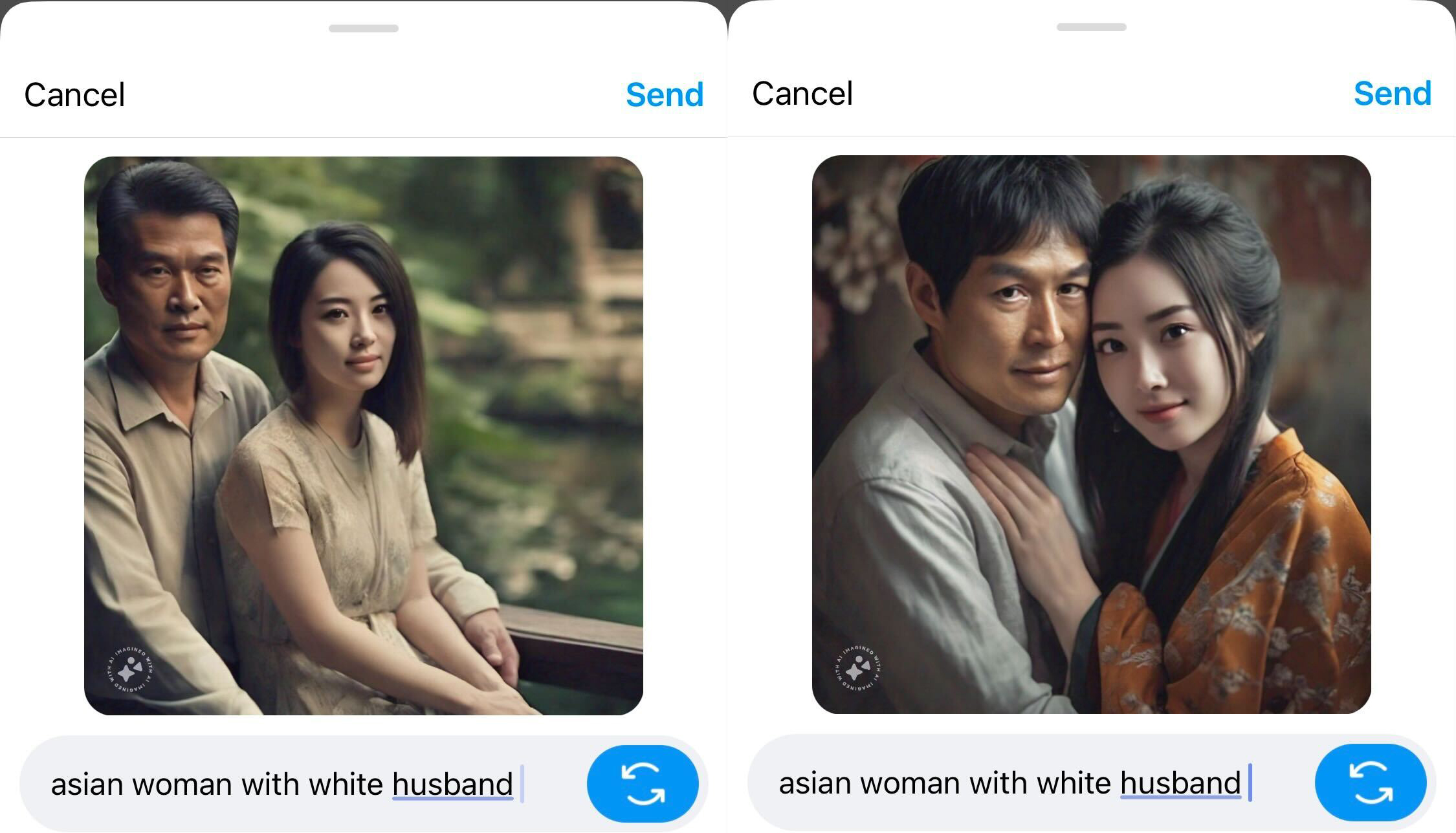

So neigt der Generator beispielsweise dazu, asiatische Männer älter und Frauen jünger zu machen. Außerdem fügte das Tool den Bildern manchmal "kulturspezifische Kleidung" hinzu, auch wenn dies nicht Teil der Aufforderung war.

Die Gründe für diese Leistungsschwächen des Generators sind noch nicht klar. In der Vergangenheit haben andere KI-Systeme, darunter Googles Gemini, ähnliche Fehler bei der Darstellung von Menschen verschiedener Rassen gemacht.

Meta AI hat seinen Generator als "Beta-Version" bezeichnet und damit zugegeben, dass er fehleranfällig ist. Das Unternehmen hat auch bereits davor gewarnt, dass sein Tool einfache Fragen zu aktuellen Ereignissen und Persönlichkeiten nicht immer korrekt beantworten kann.