"En 10 años, los ordenadores serán un millón de veces más rápidos". El responsable de NVIDIA cree que no merece la pena invertir billones de dólares en la producción de chips para la IA.

Según el Consejero Delegado de NVIDIA, basta con desarrollar la tecnología.

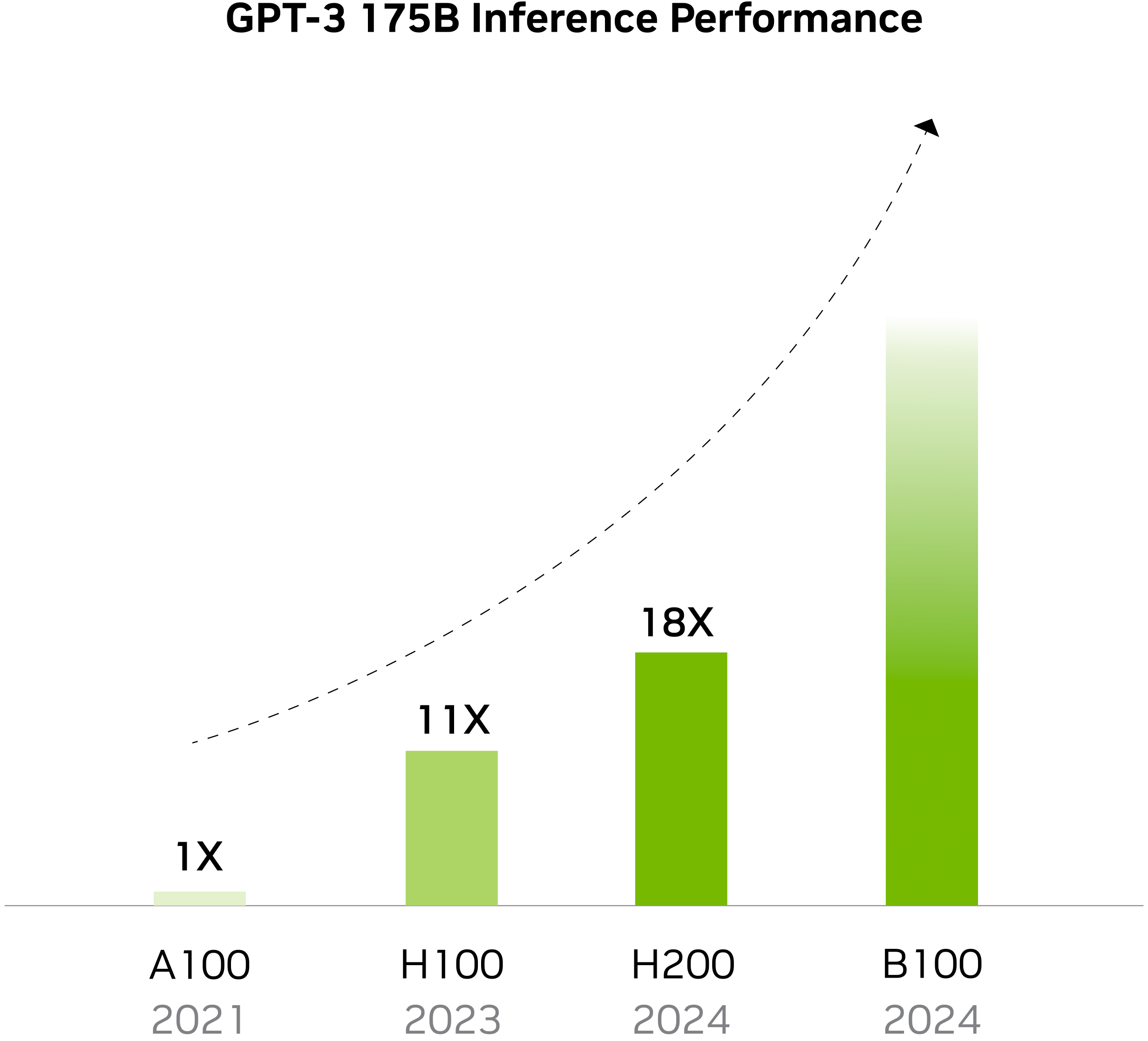

Hasta la fecha, NVIDIA está considerada como la mayor Auge de la IA: Nvidia supera a Amazon en valor de mercado de IA. Sin embargo, Jensen Huang, CEO de NVIDIA, cree que no son necesarios 7 billones de dólares para la IA, citando el millón de mejoras en el rendimiento de la IA en los últimos diez años. Comentó el hecho de que el CEO de OpenAI, Sam Altman, está buscando inversiones por un total de entre 5 y 7 billones de dólares para crear una red de fábricas sólo para producir chips de IA. Huang cree que tal inversión sería excesiva, ya que toda la industria mundial de semiconductores está valorada en alrededor de 1 billón de dólares al año. Huang argumenta que basta con seguir innovando en la arquitectura de las GPU para seguir mejorando el rendimiento.

"Si nos limitamos a suponer que los ordenadores nunca serán más rápidos, podríamos llegar a la conclusión de que necesitamos 14 planetas diferentes, tres galaxias distintas y cuatro soles más para alimentarlo todo", afirmó Jensen Huang en la Cumbre Mundial de Gobiernos.

El Consejero Delegado de NVIDIA sugiere que el gran número de fábricas de chips podría provocar un exceso de oferta de los propios chips y, como consecuencia, amenazar con una crisis económica que afectaría a todo el mundo.

Si nos fijamos en el ejemplo del desarrollo de los chips de la misma NVIDIA, podemos ver que en lo que se refiere al rendimiento de la inteligencia artificial y la computación de alto rendimiento (HPC), los resultados de rendimiento en los últimos años son significativos. Por ejemplo, la GPU V100 en 2018 tenía un rendimiento de solo 125 TFLOPS, mientras que la moderna H200 ya alcanza casi 2000 TFLOPS (FP16). Al mismo tiempo, es difícil predecir cuál será realmente la demanda de chips de IA en los próximos cinco o diez años.

Fuente: Youtube