"Tra 10 anni i computer saranno un milione di volte più veloci". Il capo di NVIDIA ritiene che non valga la pena investire trilioni di dollari nella produzione di chip per l'IA.

Secondo il CEO di NVIDIA, è sufficiente sviluppare la tecnologia.

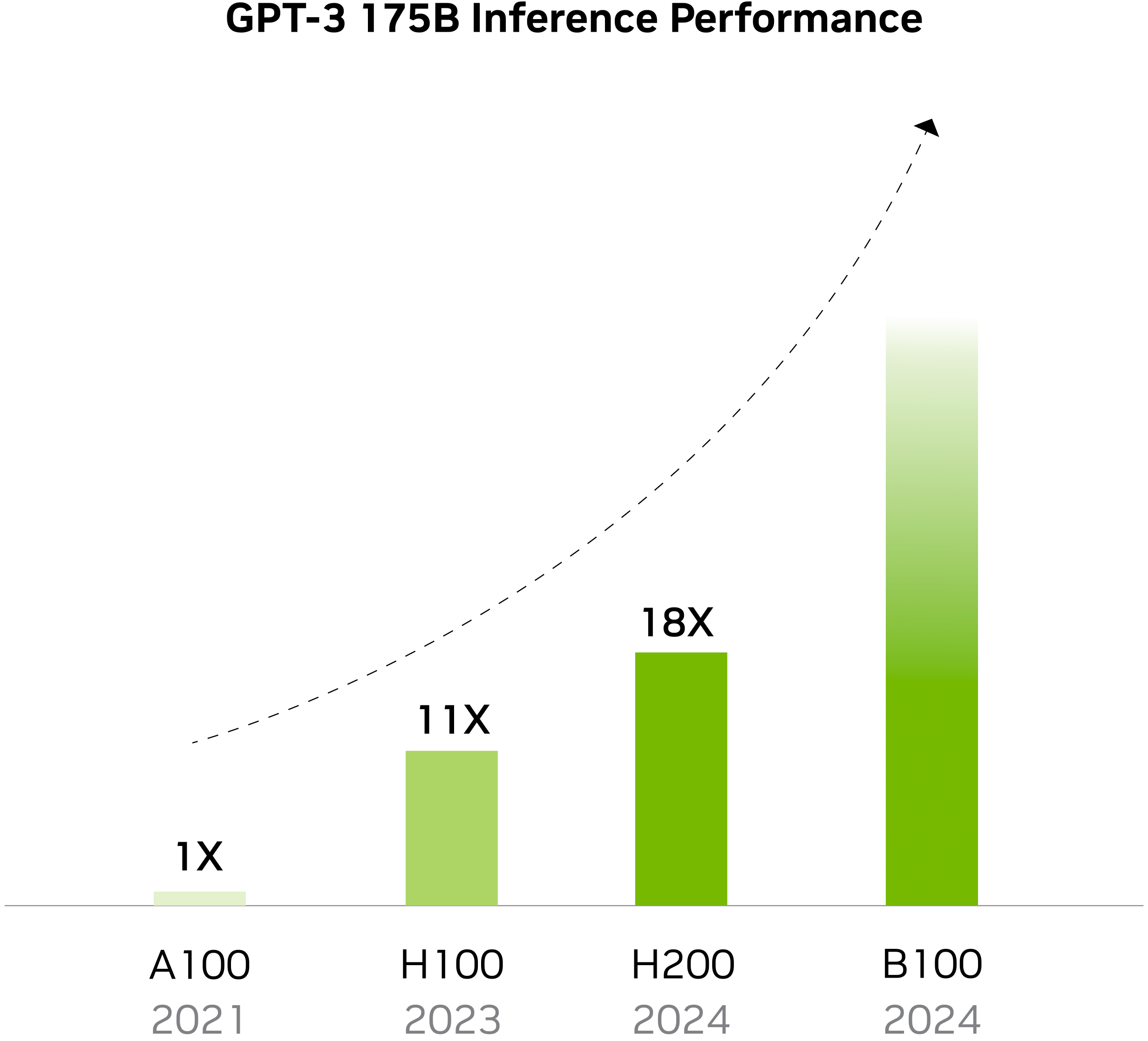

Ad oggi, NVIDIA è considerata il maggior Boom dell'intelligenza artificiale: Nvidia supera Amazon in termini di valore di mercato . Tuttavia, il CEO di NVIDIA Jensen Huang ritiene che 7 trilioni di dollari non siano necessari per l'IA, citando il milione di miglioramenti delle prestazioni dell'IA negli ultimi dieci anni. Ha commentato il fatto che Sam Altman, CEO di OpenAI, sta cercando investimenti per un totale di 5-7 trilioni di dollari per creare una rete di fabbriche solo per produrre chip AI. Huang ritiene che un tale investimento sarebbe eccessivo, dato che l'intera industria globale dei semiconduttori è valutata circa 1.000 miliardi di dollari all'anno. Huang sostiene che basta continuare a innovare l'architettura delle GPU per continuare a migliorare le prestazioni.

"Se si parte dal presupposto che i computer non diventeranno mai più veloci, si potrebbe concludere che abbiamo bisogno di 14 pianeti diversi, tre galassie diverse e quattro soli in più per alimentarli tutti", ha dichiarato Jensen Huang al World Government Summit.

Il CEO di NVIDIA suggerisce che l'elevato numero di fabbriche di chip potrebbe portare a un eccesso di offerta di chip stessi e, di conseguenza, minacciare una crisi economica che colpirebbe il mondo intero.

Se consideriamo l'esempio dello sviluppo dei chip della stessa NVIDIA, possiamo notare che quando si tratta di intelligenza artificiale e di prestazioni di calcolo ad alte prestazioni (HPC), i risultati delle prestazioni negli ultimi anni sono significativi. Ad esempio, la GPU V100 nel 2018 aveva prestazioni di soli 125 TFLOPS, mentre la moderna H200 raggiunge già quasi 2000 TFLOPS (FP16). Allo stesso tempo, è difficile prevedere quale sarà la domanda di chip AI nei prossimi cinque-dieci anni.

Fonte: Youtube