Фізика «цифрової алхімії»: гарвардські вчені вивели формулу інтелекту нейромереж

Довгий час навчання великих мовних моделей нагадувало середньовічну алхімію: ми просто закидаємо в «котел» гігабайти тексту та терафлопси потужності, сподіваючись, що на виході отримаємо розумного співрозмовника. Інженери бачили, що при збільшенні обсягів даних моделі стають розумнішими, але точні пропорції та причини цього процесу залишалися в зоні здогадок. Група фізиків-теоретиків із Гарвардського університету (Harvard University) вирішила, що з емпіричним тиканням пальцем у небо час закінчувати, та представила роботу, яка описує навчання ШІ як строгий фізичний процес.

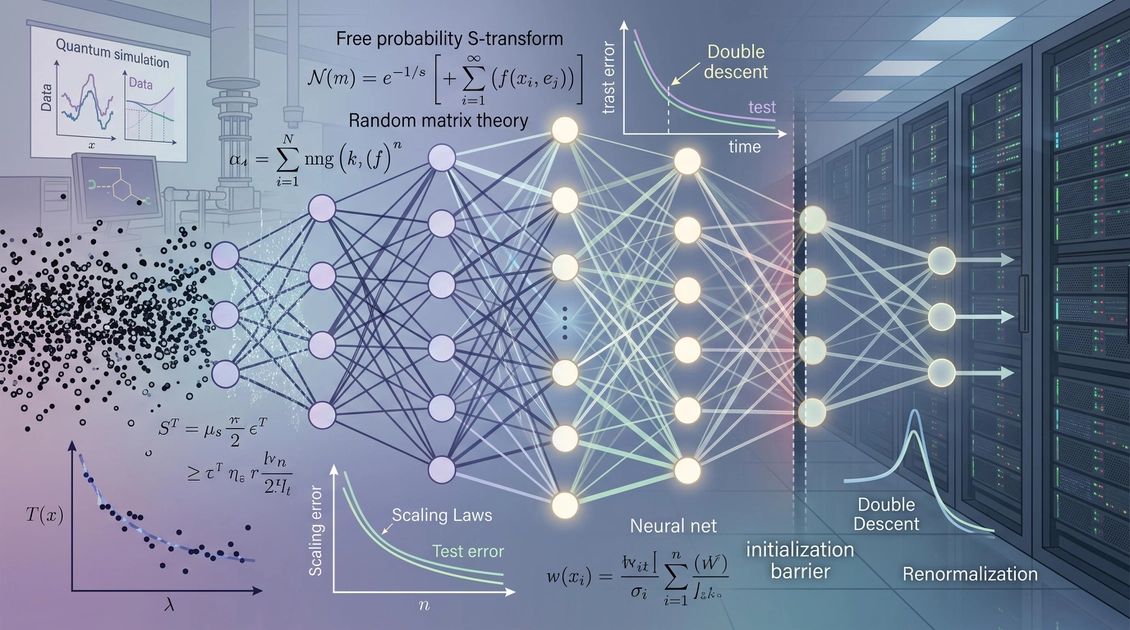

Від квантових флуктуацій до ваг нейромережі

Центральною ідеєю дослідження стала концепція перенормування (renormalization), запозичена з квантової теорії поля. Фізики виявили, що статистичний шум у даних під час навчання моделі поводиться подібно до квантових флуктуацій у фізиці елементарних частин. Цей шум фактично «переписує» параметри моделі, створюючи ефект неявної регуляризації. Це пояснює, чому сучасні системи зберігають стійкість навіть у режимі перепараметризації, коли кількість внутрішніх параметрів мережі в рази перевищує кількість навчальних прикладів.

Використовуючи апарат теорії випадкових матриць, дослідники вивели аналітичні формули для так званих законів масштабування (scaling laws). Це ті самі правила, які дозволяють великим гравцям ринку передбачати здібності майбутньої GPT-5 або Claude 4 ще до того, як на її навчання буде витрачено перший мільйон доларів. Тепер ці прогнози базуються не на статистичних спостереженнях, а на фундаментальних принципах статистичної механіки.

Математичні «чит-коди» та закони масштабування

Щоб не потонути в багатосторінкових обчисленнях, вчені застосували S-преобразовання з вільної теорії ймовірностей. Цей інструмент дозволив замінити громіздкий «метод реплік» елегантними алгебраїчними рівняннями. Завдяки цьому вдалося точно пов'язати помилку навчання з помилкою тесту (train-test gap). Практична цінність тут очевидна: тепер якість роботи нейромережі можна оцінити, спираючись лише на тренувальні дані, не проводячи дорогі тести на гігантських вибірках.

Дослідження також дає фізичне пояснення феномену «подвійного спуску» (double descent). Це той дивний момент у навчанні, коли при збільшенні складності моделі точність спочатку падає, а потім раптово починає зростати. Гарвардські фізики показали, що це не аномалія, а закономірна фізична сингулярність. По мірі зростання обсягу даних «ефективний параметр» моделі змінюється, дозволяючи системі знаходити простіші та точніші рішення там, де раніше був лише шум.

Чому «більше» не завжди означає «краще»

Одним із найпротверезніших висновків роботи став так званий «бар'єр ініціалізації». В індустрії звикли вважати, що чим ширша нейромережа, тим вона перспективніша. Проте математика доводить: існує межа. У певних режимах випадковість початкових параметрів починає домінувати над корисним сигналом. У такому разі подальше «роздування» моделі стає безглуздим спалюванням електрики. Замість нарощування ширини фізики радять використовувати ансамблювання — об'єднання кількох різних мереж в одну систему.

Щоб зробити ШІ розумнішим, потрібно не просто більше даних, а розуміння фізичних законів їхньої обробки.

Ця теоретична база дозволяє перенести навантаження з бездумного перебору гіпотез на інтелектуальне проектування архітектур. В епоху, коли вартість навчання моделей вимірюється мільярдами доларів, розуміння того, де знаходяться «вузькі місця» (bottlenecks), стає критично важливим для виживання технологічних компаній.

До речі, поки фізики розбираються з математикою на Землі, Google та SpaceX планують відправити ШІ в космос, щоб розгорнути перші орбітальні дата-центри вже до 2027 року.