Google a été accusé d'avoir falsifié une vidéo démontrant les capacités d'IA de Gemini.

Google a publié une vidéo démontrant le travail d'un nouveau modèle multimodal d'intelligence artificielle, Gemini. La vidéo a rapidement atteint un million de vues, mais il est vite apparu qu'il s'agissait en fait d'une production.

Ce que nous savons

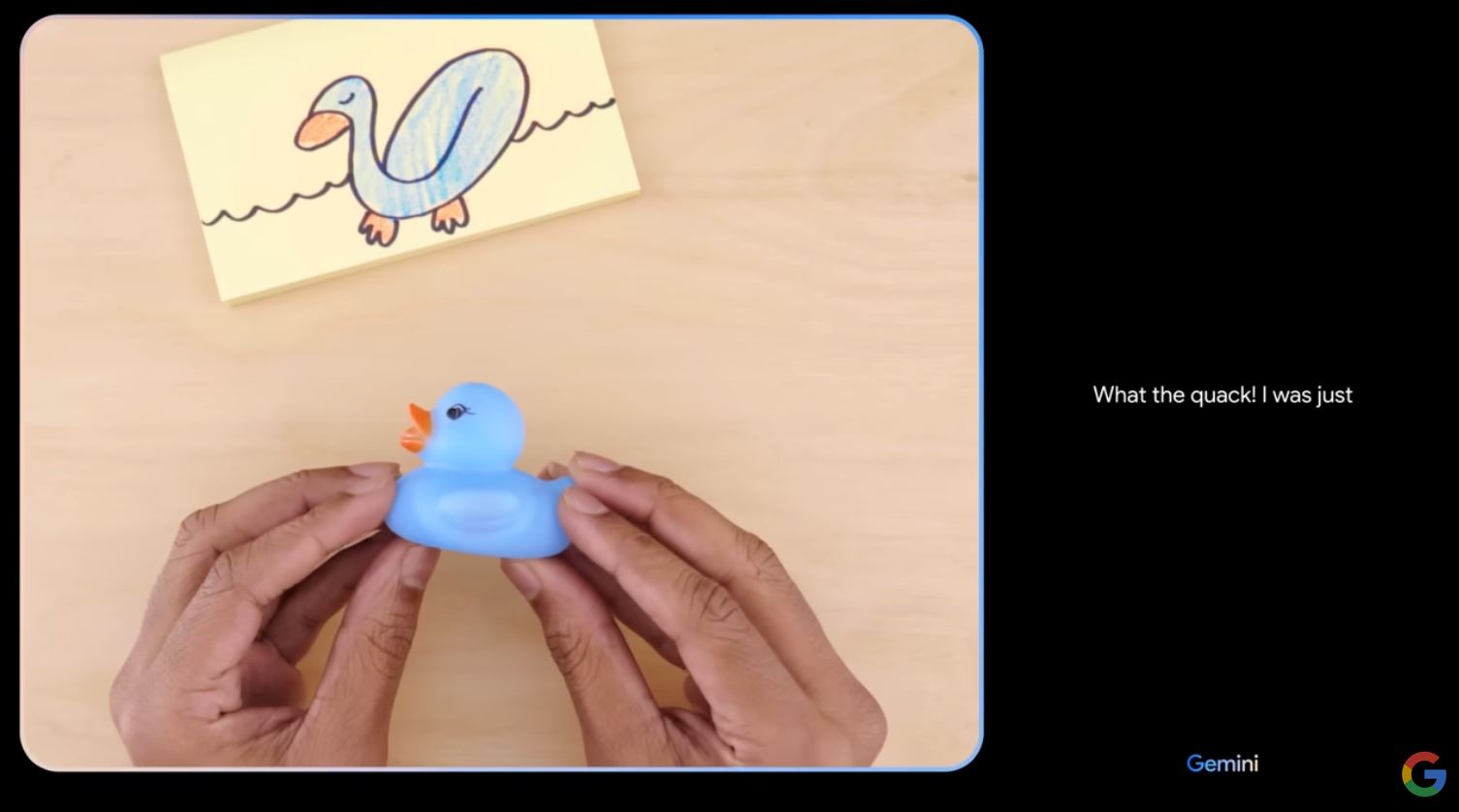

Dans la vidéo, Gemini répond à des commandes vocales, reconnaît des images et des gestes, ce qui semble impressionnant pour un système d'intelligence artificielle. Toutefois, les journalistes ont constaté que le modèle répondait aux questions posées par un texte préparé à l'avance, ce qui signifie que l'interaction a été fabriquée.

Un porte-parole de Google a déclaré que la vidéo montrait les résultats réels du travail de Gemini. Il a également admis que des modifications avaient été apportées pour améliorer la démonstration. Néanmoins, selon les experts, la vidéo induit les spectateurs en erreur et n'est pas conforme au format "Hands-on".

L'incident a ébranlé la crédibilité du géant de la technologie. Jusqu'à présent, Google est à la traîne par rapport à ses concurrents dans le domaine de l'IA, ce qui remet en question sa réputation de partenaire fiable, selon les experts.

Selon les observateurs, de telles productions ne peuvent que nuire à Google. Au lieu de démontrer honnêtement les capacités actuelles de Gemini, l'entreprise a opté pour la falsification. Cela pourrait avoir un impact négatif sur l'image de Google et sur la confiance dans ses développements en matière d'IA.

Approfondir :

Source : TechCrunch TechCrunch