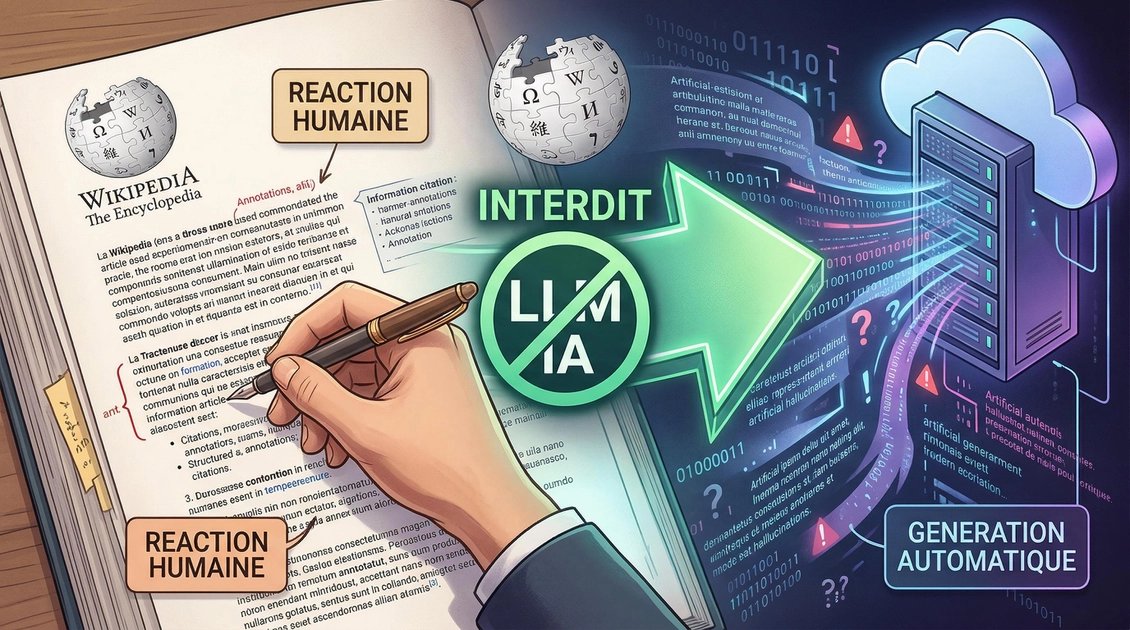

Wikipedia ferme la porte aux robots : l’IA désormais persona non grata pour la rédaction

L’encyclopédie la plus célèbre du web vient de poser une limite claire à l’invasion des algorithmes. Après des mois de débats internes et une lassitude croissante face à la prolifération de contenus générés par machine, la communauté des éditeurs de Wikipedia a voté massivement pour interdire l’usage des modèles de langage (LLM) dans la rédaction ou la réécriture des articles. Le message est limpide : si vous voulez contribuer, utilisez votre cerveau, pas celui d’OpenAI ou de Google.

Une règle enfin explicite face au flou artistique

Jusqu’à présent, Wikipedia naviguait dans une zone grise avec des directives plutôt évasives. L’ancienne version de la politique stipulait simplement que les LLM « ne devraient pas être utilisés pour créer de nouveaux articles à partir de zéro ». Une formulation qui laissait la porte ouverte à toutes les interprétations, notamment celle consistant à faire mâcher le travail par une IA pour ensuite le « repasser » manuellement. Désormais, le nouveau règlement ne laisse plus de place au doute : l’utilisation de l’IA pour générer ou réécrire le contenu des articles est formellement interdite.

Ce changement n’est pas le fruit d’une décision arbitraire de la Fondation Wikimedia, mais bien d’un vote de la communauté. Selon les rapports de 404 Media, le scrutin a été sans appel avec 40 voix contre 2. Ce score reflète l’agacement des bénévoles qui passent de plus en plus de temps à nettoyer des textes qui, sous une apparence de neutralité parfaite, cachent souvent des erreurs factuelles grossières ou des sources totalement inventées.

L’exception qui confirme la règle (et ses dangers)

Toutefois, Wikipedia ne sombre pas dans le luddime total. L’IA reste tolérée pour des tâches purement techniques et périphériques. Les éditeurs peuvent solliciter des outils pour suggérer des corrections orthographiques ou des ajustements de style sur leurs propres écrits. Mais attention : l’humain doit rester le seul maître à bord.

Les éditeurs sont autorisés à utiliser les LLM pour suggérer des corrections de base à leurs propres écrits et à en incorporer certaines après une révision humaine, à condition que le LLM n'introduise pas de contenu propre.

La prudence reste de mise car, comme le souligne la nouvelle politique, ces outils ont une fâcheuse tendance à déborder de leur cadre initial. Un simple assistant de style peut, en une fraction de seconde, modifier le sens d’une phrase ou introduire une nuance qui ne figure pas dans les sources citées. Pour une plateforme dont la crédibilité repose sur la vérifiabilité, c’est un risque mortel.

Pourquoi cette bataille est cruciale pour le web

Cette décision intervient alors que le web est menacé par ce que certains appellent la « théorie de l'Internet mort », où le contenu est généré par des machines pour être lu par d'autres machines (ou des algorithmes de référencement). En refusant de devenir un dépotoir pour les textes de synthèse, Wikipedia tente de préserver son statut de sanctuaire de la connaissance humaine.

Les chiffres sont là pour rappeler l'ampleur du défi : avec des millions de modifications chaque mois, la surveillance manuelle devient un travail de titan. Si l’IA permet de produire du texte à un coût quasi nul, le coût de la vérification, lui, explose. En interdisant l'IA à la source, la communauté espère décourager les contributeurs paresseux avant qu'ils ne polluent la base de données. C'est une question de survie pour l'encyclopédie, qui refuse de voir ses pages devenir des hallucinations collectives générées par des serveurs en Californie.

Pendant que certains sites se ferment à l'automatisation, d'autres l'intègrent au cœur de l'expérience utilisateur. C'est le cas de Google Search Live, une fonctionnalité où l'intelligence artificielle analyse en temps réel ce que vous regardez pour vous fournir des informations, illustrant parfaitement la trajectoire opposée prise par les géants du secteur.