Cisco lance un outil open source pour vérifier l'origine des modèles d'IA

Cisco vient de publier en open source un outil baptisé Model Provenance Kit, conçu pour vérifier l'origine et l'intégrité des modèles d'intelligence artificielle avant leur déploiement. Sur des plateformes comme Hugging Face, qui héberge plus de deux millions de modèles, les entreprises téléchargent régulièrement des versions modifiées sans savoir ce qui a changé — ni pourquoi. Une recherche conjointe d'Anthropic confirme que 250 documents malveillants suffisent à introduire une porte dérobée dans un grand modèle de langage, quelle que soit sa taille.

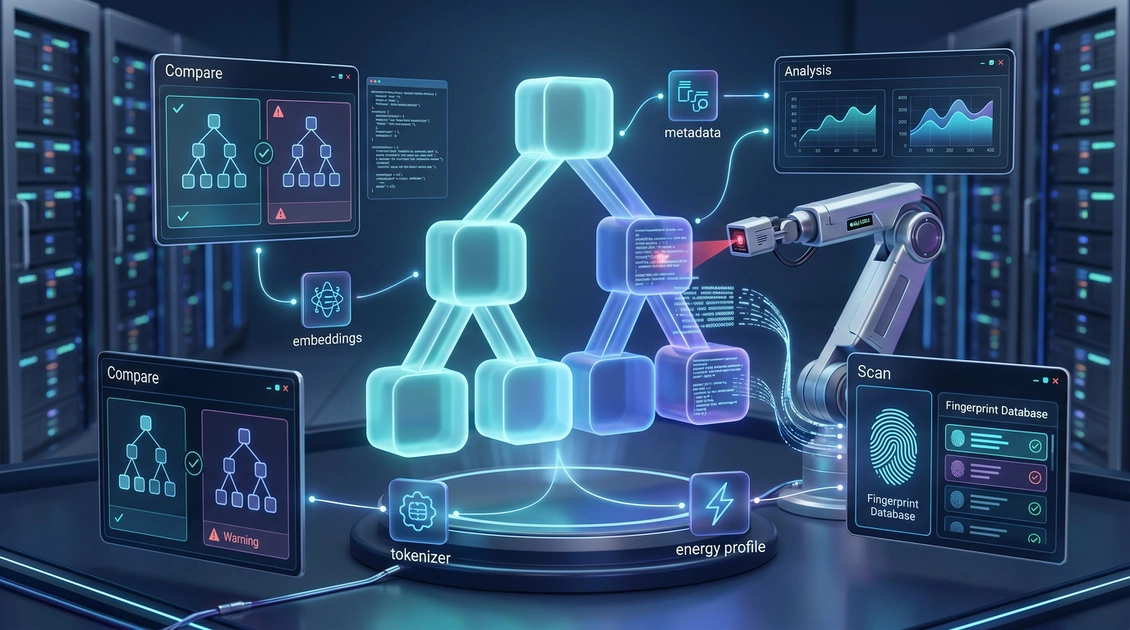

Le principe : une empreinte pour chaque modèle

L'outil, écrit en Python et doté d'une interface en ligne de commande, ne se contente pas de lire la documentation fournie avec un modèle. Il analyse un ensemble de signaux techniques pour construire une empreinte unique : métadonnées et architecture, similarité des tokeniseurs, géométrie des embeddings, caractéristiques des couches de normalisation, et profils énergétiques. Cette combinaison permet de détecter des modifications même lorsque la documentation a été altérée ou supprimée.

Le kit fonctionne selon deux modes. Le mode compare confronte directement deux modèles pour établir s'ils partagent une filiation — utile pour vérifier qu'un modèle tiers est bien ce qu'il prétend être. Le mode scan interroge une base de données d'empreintes que Cisco a déjà constituée, couvrant environ 150 modèles de base répartis en 45 familles, de 135 millions à 70 milliards de paramètres. Sur un banc de test de 111 paires de modèles incluant distillation, quantification et fine-tuning inter-organisations, l'outil affiche une précision de 96,4 % et une précision de 98,1 %, selon Help Net Security.

Cisco publie également une Model Provenance Constitution, un cadre formel qui définit ce qui constitue une relation de dérivation entre modèles — une base commune qui manquait jusqu'ici dans l'industrie.

Un enjeu réglementaire concret

Pour les entreprises françaises, l'enjeu dépasse la simple sécurité informatique. Les obligations de transparence de l'AI Act européen pour les systèmes à haut risque entrent pleinement en vigueur le 2 août 2026. Documenter la provenance d'un modèle pourrait devenir une exigence de conformité tangible, notamment pour les secteurs de la finance, de la santé ou de l'industrie.

La CNIL et l'ARCEP n'ont pas encore précisé dans quelle mesure un outil open source tiers peut servir de preuve documentaire suffisante. Des acteurs comme OVHcloud ou Mistral n'ont pas non plus signalé de tests ou d'intégration prévus. En attendant, le kit est disponible dès maintenant sur GitHub Cisco AI Defense, sans coût de licence.

Pour les équipes qui intègrent des modèles ouverts dans leurs pipelines, c'est une couche de vérification concrète là où il n'en existait aucune.