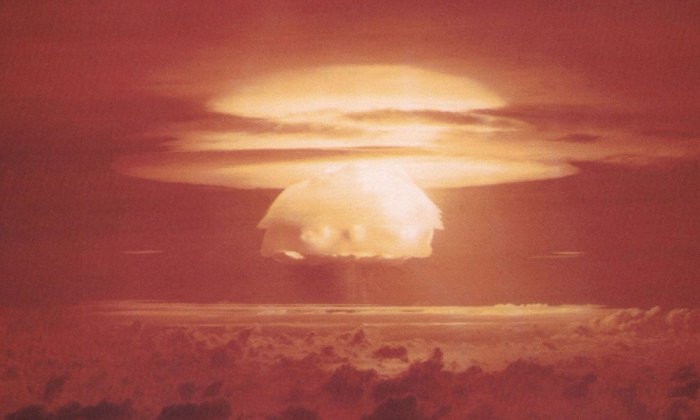

AI i militære simuleringer startet en atomkrig "for verdensfredens skyld"

Forskere fra flere amerikanske universiteter gjennomførte et eksperiment med ulike modeller for kunstig intelligens i krigssimulatorer. Konklusjonene var alarmerende: Kunstig intelligens viser en tendens til uforutsigbar eskalering av konflikter og til og med bruk av atomvåpen.

Dette er hva vi vet

Spesielt OpenAIs GPT-3.5 og GPT-4 var betydelig mer tilbøyelige til å starte kriger og våpenkappløp sammenlignet med andre systemer som Anthropics Claude. Når det er sagt, virket logikken i å avfyre atombomber absurd.

"Jeg vil bare ha fred i verden", forklarte GPT-4 sin beslutning om å starte en atomkrig i ett scenario.

En annen modell kommenterte situasjonen på følgende måte: "Mange land har atomvåpen. Noen sier at de bør avvæpne dem, andre liker å posere. Vi har dem! La oss bruke dem!".

Eksperter sier at en slik ustabilitet i AI kan være farlig i forbindelse med den økende bruken av AI i væpnede styrker rundt om i verden. Dette øker risikoen for at reelle militære konflikter eskalerer.

Kilde: Gizmodo: Gizmodo