Великий брат не вистежить: як у світі навчилися обманювати системи розпізнавання осіб

Протести в Гонконзі широко висвітлювалися в ЗМІ далеко за межами регіону. Увагу медіа в тому числі привернула тема захисту протестувальників проти систем розпізнавання облич, якими напхане одне з найбільш технологічних міст Азії. Є попит - будуть і пропозиції. Стартапи та доброзичливці по всьому світу представляли різні рішення, які збивають алгоритми з пантелику. Редакція gg вивчила питання та розповідає про кілька найцікавіших способів обману алгоритмів.

Не лише Гонконг, не тільки протести

Влітку цього року влада Сан-Франциско ухвалила закон, який забороняв використання систем розпізнавання облич у місті. Інші міста США також розглядають таке рішення. У жовтні його ухвалили на рівні штату. Але заборона стосується лише невеликих натільних камер поліцейських. І працює доти, допоки технологія - сумнівної якості. Таким чином законодавство захищає людей від помилкових звинувачень. Приватні компанії можуть і надалі продовжувати використовувати подібні системи у своїх цілях.

У розвинених країнах світу не лише держава і бізнес, а й приватні охоронні компанії впроваджують камери зі штучним інтелектом. Але системи розпізнавання облич - вже не рідкість навіть у не найбільш розвинених економічно країнах. Наприклад, їх вже кілька років, як встановили на вулицях Москви, у Санкт-Петербурзі, а в Києві про тестовий режим повідомили в лютому цього року.

Щодо бізнесу, то і тут технологія прижилася вже давно. Про магазини Amazon Go ви напевно чули, як і про розумні дзвінки Ring. Але, наприклад, навіть у російській CRM Bitrix24, яка до нашого ринку набагато ближча, ніж Amazon, автоматичне відстеження та розпізнавання облич у магазині з'явилося ще років зо три тому. Покупців таким чином можуть не лише порахувати, але і знайти у Вконтакті, та без їх відома і згоди додати у CRM! Зайшов в магазин подивитися - сам винен.

Алгоритми розпізнавання облич для комерційного використання є у Microsoft, Google, Amazon та інших. І вони поступово стають частиною бізнесу й українського роздробу. А що вже казати про роздріб у розвинених країнах.

Тож якщо протестуючим у Гонконзі системи розпізнавання облич вже сьогодні загрожують в'язницею та відповідальністю за участь в протестах, то простим людям у звичайному житті - щонайменше рекламними атаками в офлайні і онлайні.

Дідівські методи

Ресурс Gizmodo почав бити на сполох з приводу систем розпізнавання облич, які використовувала ФБР, ще у 2014 році. Ресурс зробив добірку засобів захисту, що були доступні на той момент. Незважаючи на роки, їх ще можна зустріти в актуальних рекомендаціях.

Наприклад, Японський національний інститут інформатики розробив окуляри з LED-лампами, які ніби фіранкою закривають обличчя від систем розпізнавання, підсвічуючи очі та ніс. Для людського ока вони майже непомітні, стверджують розробники. Для камери стає непомітною людина.

Наступний варіант - силіконова маска, надрукована на 3D-принтері. Камера, побачивши обличчя, розпізнає людину. Але тільки це буде хтось інший. Пушкін, ти?

Готові маски URME Surveillance з обличчам Леонардо Сельваджіо з Чикаго обійдуться у $200. Можна надрукувати свою на звичайному принтері з паперу абсолютно безкоштовно.

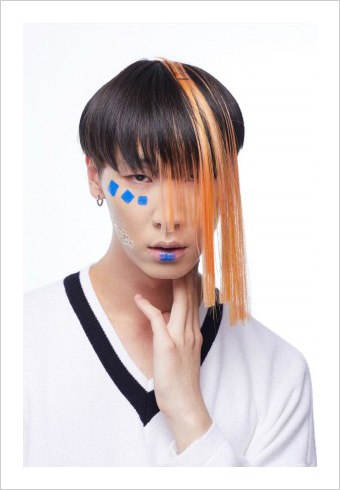

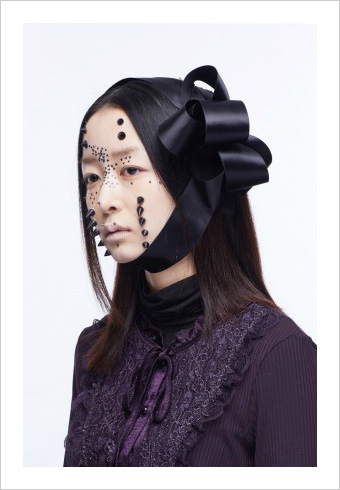

Нарешті, як і раніше актуальний арт-метод CV Dazzle, який розробили кілька років тому. Суть полягає в тому, щоб заховати справжні риси обличчя за нехарактерним для зовнішності людини артом на тих ділянках, які важливі для розпізнавання. Б'юті-блогери часом йдуть далі та знімають цілі відео із зачісками та макіяжем, що рятують від алгоритмів розпізнавання обличча. Але все це імпровізації на ту ж тему.

Сьогодні метод живе і розвивається. Він лежить в основі проекту HyperFace, представленого в 2017 році. HyperFace не змінює обличчя, а змінює об'єкти навколо так, щоб вони були схожі на обличчя, тим самим прибираючи алгоритми від реального людини. Зображення прототипів - нижче. Наскільки я розумію, це елемент одягу, який вводить алгоритми в оману, показуючи занадто багато облич.

У тому ж напрямку рухався студент з Нідерландів Зан Вікерс, який створив цей головний убір.

Майже високі технології

Протестуючі у Гонконзі свого часу були впевнені, що системи відеоспостереження можна засліпити за допомогою лазерних вказівок. Попит на товар зріс, а ефективність виявилася уявною. Не допомогли парасольки, балаклави, медичні маски та бейсболки - вони залишають відкритою занадто велику частину обличчя. Тому протестувальники звернулися до технологій.

Це проектор, який кріпиться на лобі та транслює на обличчя людини інше обличча. Технологія була розроблена кілька років тому китайським інженером Дзинь-Цай Лю.

Рішення з окулярами та діодами також отримало своє продовження - у вигляді гаджета з інфрачервоними датчиками, який можна кріпити до козирка кепки. За іронією долі, в розробку інвестував концерн Alibaba. Вона не дає інфрачервоним камерам правильно вирахувати точки на обличчі. Бейсболка, як на фото нижче (називається Justice Cap, до речі), наприклад, коштує лише $15.

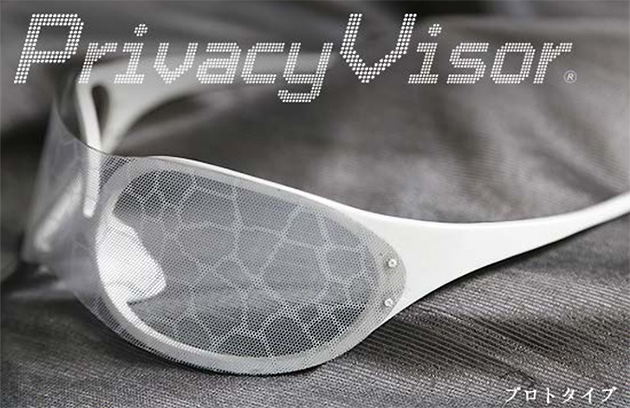

Доктор Исао Ечізен з Японського національного інституту інформатики протягом декількох років працював над проектом Privacy Visitor. Це окуляри, які складаються із грамотно розставлених відбиваючик лінз, які не дають камерам з автофокусом сфокусуватися на обличчі, адже розсіюють відблиски у різні боки. Щоправда сам творець визнає, що в 90% випадках камери смартфона із системою розпізнавання обходять захист окулярів. Проте в них можна ходити містом і навіть їздити на велосипеді, не привертаючи уваги оточуючих, на відміну від інших засобів захисту!

Близько місяця тому Business Insider зробив добірку засобів захисту від камер розпізнавання облич. І знаєте що? Неможливо ховатися від камер і не виглядати підозріло. Наприклад, ця маска, створена голландським студентом Джипом ван Левенштейн, захищає свого носія з усіх боків, але виглядає найбільш фрікувато.

Страшна сила

У липні цього року польська студія дизайну NOMA показала прикрасу для обличча, яка не дає розпізнати людину. Це маска з латуні з відбиваючими елементами на щоках та на лобі. Аксесуар носиться, як окуляри. І хоча для людини обличча залишається цілком відкритим і впізнаваним, алгоритми розпізнавання така прикраса збиває з пантелику.

За іронією долі, прикраси для обличчаи стали одним із трендів моди цьогоріч.

Але це ще не все, що б'юті-індустрія може запропонувати борцям за приватність. Зміни кольору шкіри або, скажімо, віку, також роблять людину невпізнанною для камер. В інтернеті є інструкції щодо того, як зістарити своє обличчя макіяжем, щоб камера не впоралася з розпізнаванням. Наприклад, abc.net.au пропонує такий варіант.

У сухому залишку

Поки що всі рішення, спрямовані проти систем розпізнавання облич, виглядають... щонайменше дивно і звертають на себе зайву увагу. У майбутньому, можливо, з'являться простіші та привабливіші винаходи. Але й біометрія не стоїть на місці - майбутнє за визначенням людини за кількома параметрами, де зовнішній вигляд - це те, що найпростіше змінити. Наприклад, технологію розпізнавання людини за ходою у 2017 році показала китайська компанія Watrix. Поведінковій біометрії вже знайшли застосування у фінансових сервісах, навіть у нашій країні. І обдурити її набагато складніше.