Випускник Києво-Могилянської академії Богдан Кулинич став переможцем конкурсу Twitter з пошуку алгоритмічної упередженості

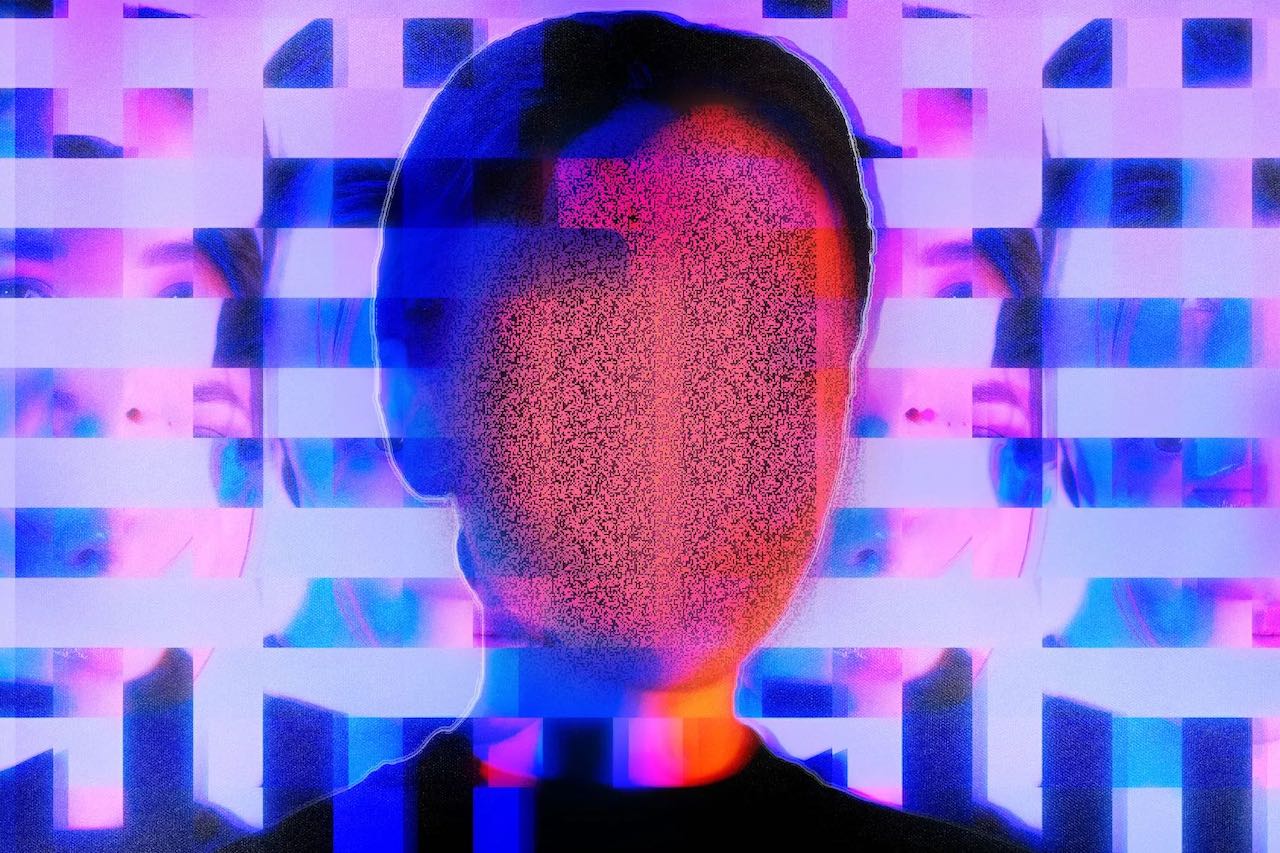

Соціальна мережа Twitter оголосила результати відкритого конкурсу з пошуку алгоритмічної упередженості в своїй системі обрізки фотографій. Компанія відключила автоматичну обрізку фотографій в березні цього року після того, як в минулому році користувачі Twitter провели експерименти, які показали, що вона віддає перевагу білим особам перед чорними. Потім компанія запустила конкурс з пошуку алгоритмічних помилок, щоб спробувати більш ретельно проаналізувати проблему.

Конкурс підтвердив зроблені раніше висновки. Робота, зайняла перше місце, показала, що алгоритм обрізки Twitter віддає перевагу особам "струнким, молодим, зі світлим або теплим кольором шкіри і гладкою текстурою шкіри, а також зі стереотипно жіночими рисами обличчя". Записи, які посіли друге і третє місця, показали, що система упереджено ставиться до людей з білими або сивим волоссям, що свідчить про дискримінацію за віком, і віддає перевагу англійській, а не арабському шрифту на зображеннях.

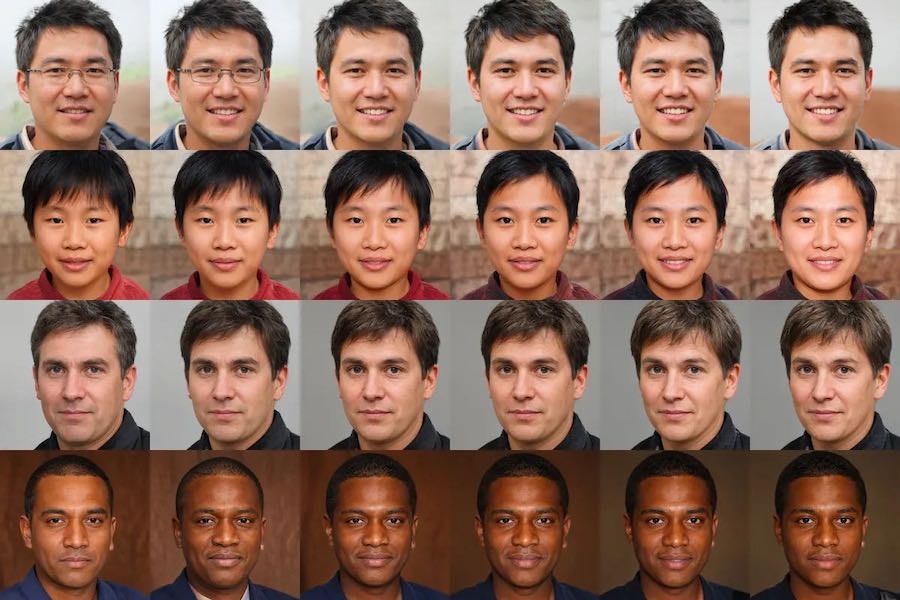

Перше місце в конкурсі і головний приз в 3500 доларів США отримав Богдан Кулинич, випускник Києво-Могилянської академії та аспірант EPFL, дослідницького університету в Швейцарії. Кулиничвикористовував програму ІІ під назвою StyleGAN2 для створення великої кількості реалістичних осіб, які він варіював за кольором шкіри, жіночим і чоловічим рисами обличчя і стрункості. Потім він ввів ці варіанти в алгоритм обрізки фотографій Twitter, щоб визначити, який з них краще.

Як зазначає Кулинич в супровідній записці, ці алгоритмічні упередження підсилюють упередження в суспільстві, буквально вирізуючи "тих, хто не відповідає перевагам алгоритму щодо ваги тіла, віку, кольору шкіри ".

Відкритий підхід Twitter контрастує з реакцією інших технологічних компаній, що зіткнулися з подібними проблемами. Наприклад, коли дослідники під керівництвом Джой Буоламвіні з Массачусетського технологічного інституту виявили расову та гендерну упередженість в алгоритмах розпізнавання осіб Amazon, компанія розгорнула масштабну кампанію з дискредитації учасників, назвавши їх роботу "вводить в оману" і "помилкової". Після багатомісячних суперечок з приводу висновків Amazon в кінці кінців здалася, наклавши тимчасову заборону на використання цих алгоритмів.

Джерело: cnet

Ілюстрації: theverge,Богдан Кулинич